搜索技巧

海洋云增白

开源地图

AI 搜索答案

沙丘魔堡2

压缩机站

自由职业

policy

小团队

颈挂空调

Chumby

个人电脑

极端主义

团队

PostgreSQL

AI工具

证券

DirectX

DrawingPics

化学

KDE

披萨农场

多动症

植物学

分析化学

Three.js

大会

残疾人学校

初创

QB64

更多

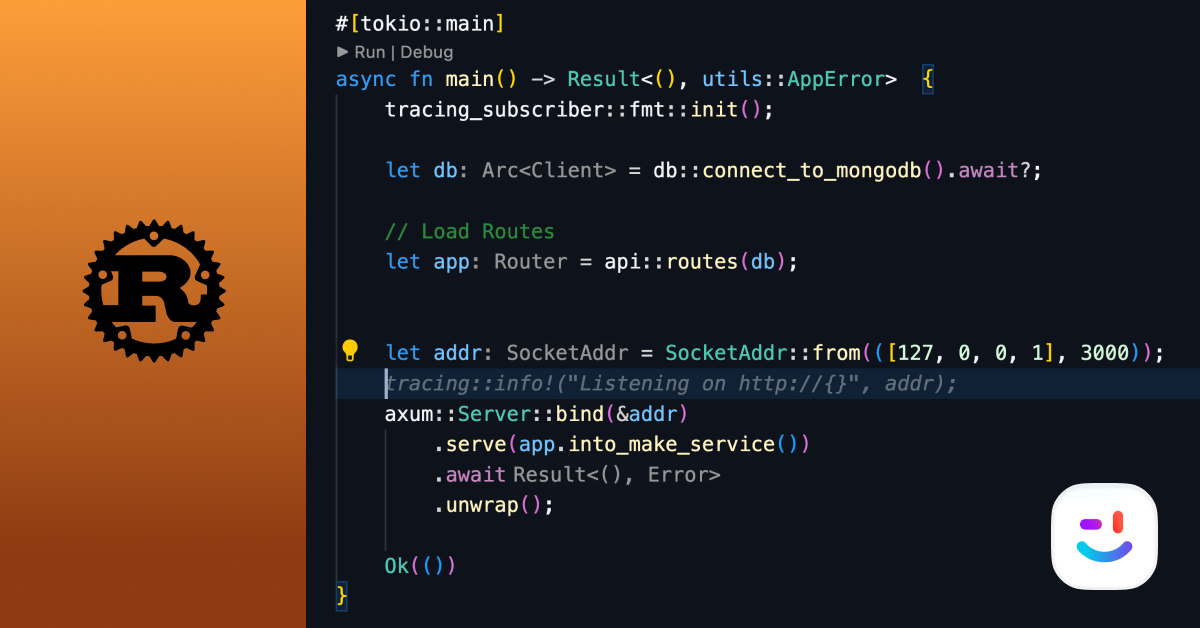

Cody 中 Rust 代码补全功能增强 (sourcegraph.com)

本文介绍了 Sourcegraph 如何改进 Cody 中 Rust 代码补全功能。由于 Rust 在训练数据集中占比不高,导致大型语言模型在 Rust 代码补全方面表现不佳。Sourcegraph 使用 LoRA 技术对 Mixtral 8x7b 和 Code Llama 34b 模型进行微调,并针对 Rust 语言创建了一个微调数据集。结果表明,经过微调的模型在 HumanEval 基准测试中表现出色,Pass@1 指标显著提高。文章还通过具体示例展示了微调模型在解决 Rust 编码问题方面的优势,例如更正错误、提高效率和逻辑完整性。最后,Sourcegraph 展望了未来的改进方向,包括开发更贴近真实编码体验的评估套件,以及将改进扩展到其他编程语言。

评论已经关闭!