LLM 0.26: Los Modelos de Lenguaje Grande Obtienen Herramientas de Terminal

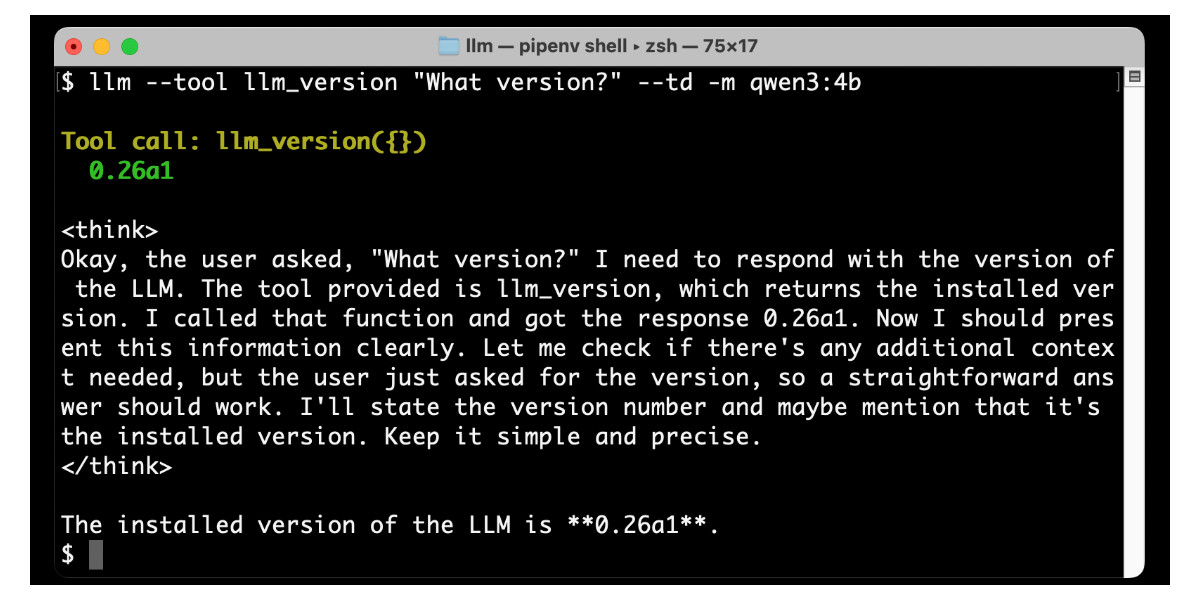

LLM 0.26 ya está disponible, con la característica más importante desde el inicio del proyecto: soporte para herramientas. La CLI de LLM y la biblioteca de Python ahora te permiten dar a los LLMs de OpenAI, Anthropic, Gemini y modelos locales de Ollama acceso a cualquier herramienta representable como una función de Python. El artículo detalla la instalación y el uso de plugins de herramientas, la ejecución de herramientas a través de la línea de comandos o la API de Python, y muestra ejemplos con OpenAI, Anthropic, Gemini e incluso el pequeño modelo Qwen-3. Más allá de las herramientas integradas, se muestran plugins personalizados como simpleeval (para matemáticas), quickjs (para JavaScript) y sqlite (para consultas de bases de datos). Este soporte para herramientas aborda las debilidades de LLM, como los cálculos matemáticos, expandiendo drásticamente las capacidades y abriendo posibilidades para aplicaciones de IA potentes.