Ajuste fino de LLMs: ¿Inyección de conocimiento o sobrescritura destructiva?

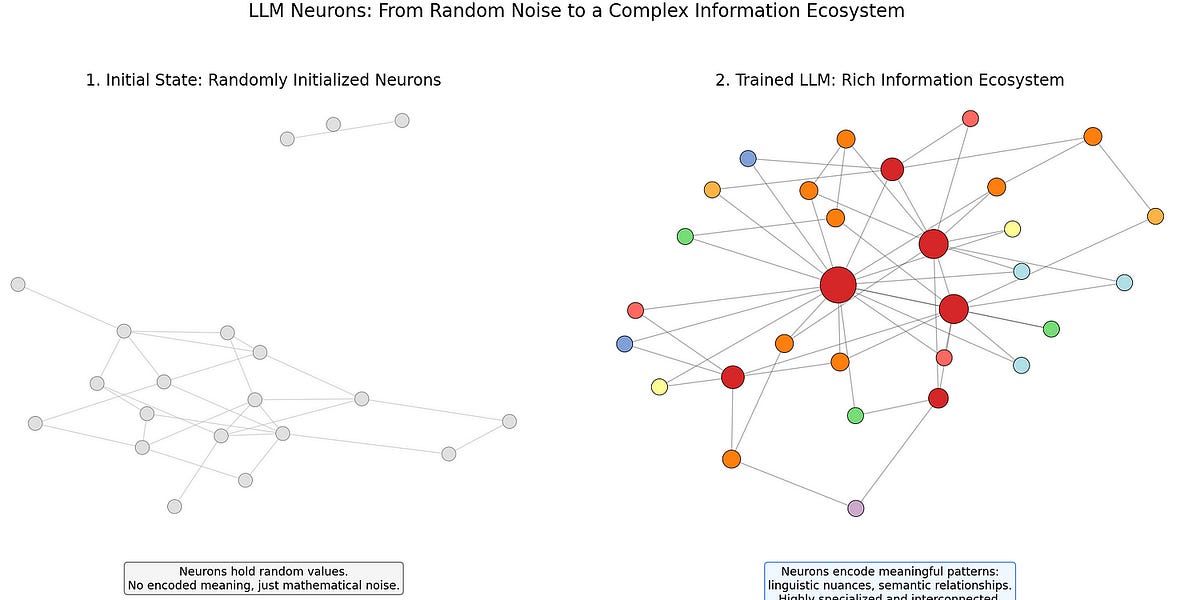

Este artículo revela las limitaciones del ajuste fino de los modelos de lenguaje grandes (LLMs). El autor argumenta que, para los LLMs avanzados, el ajuste fino no es simplemente inyección de conocimiento, sino que puede ser destructivo, sobrescribiendo estructuras de conocimiento existentes. El artículo profundiza en cómo funcionan las redes neuronales y explica cómo el ajuste fino puede llevar a la pérdida de información crucial dentro de las neuronas existentes, causando consecuencias inesperadas. El autor aboga por soluciones modulares como la generación aumentada por recuperación (RAG), los módulos adaptadores y la ingeniería de prompts para inyectar información nueva de manera más eficaz, sin dañar la arquitectura general del modelo.