Ejecutando LLMs localmente: Guía para desarrolladores

2024-12-29

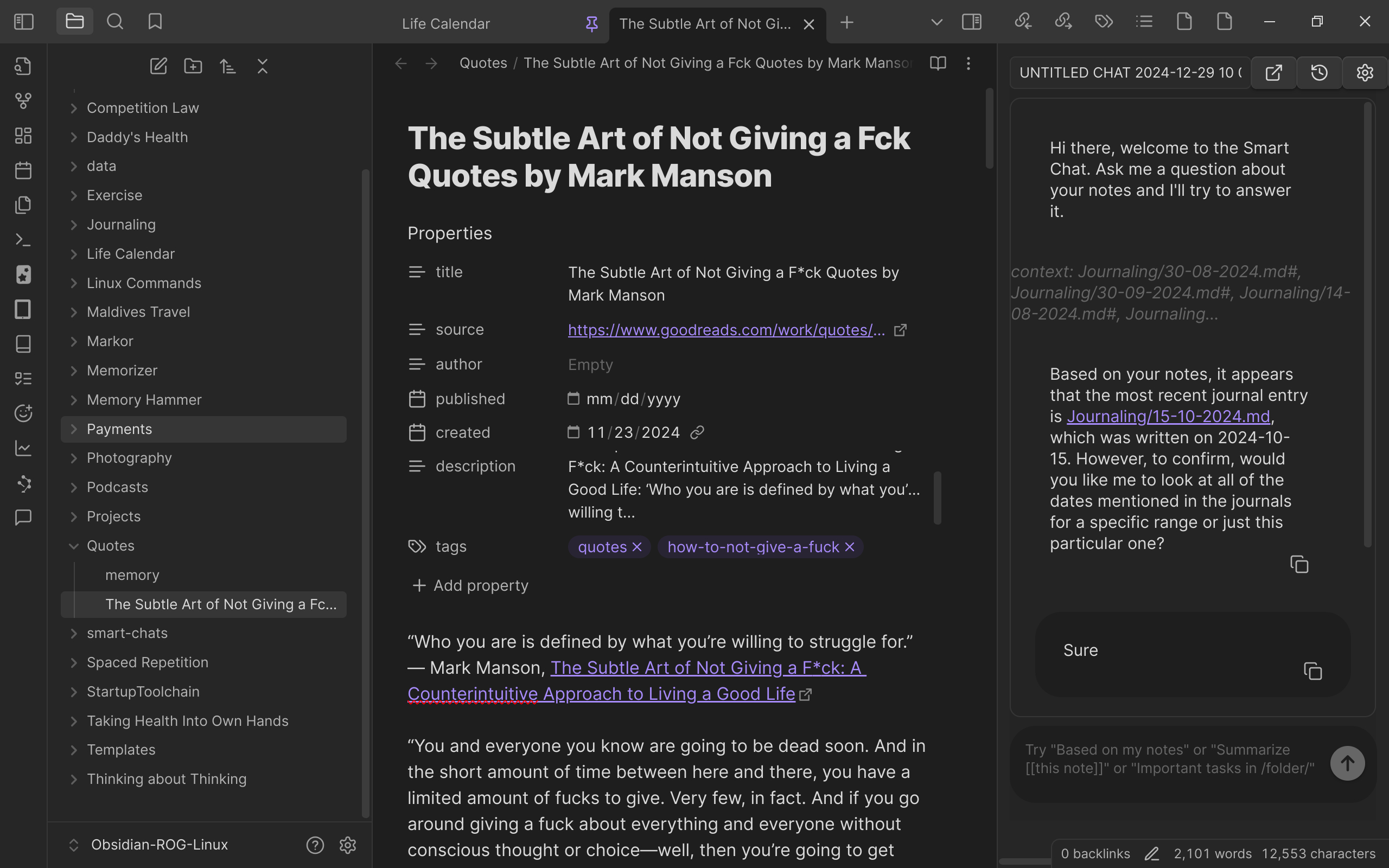

Un desarrollador comparte su experiencia ejecutando Modelos de Lenguaje Grandes (LLMs) en un ordenador personal. Utilizando un equipo de alta gama (CPU i9, GPU 4090, 96 GB de RAM), junto con herramientas de código abierto como Ollama y Open WebUI, ha ejecutado con éxito varios LLMs para tareas como la compleción de código y la consulta de notas. El artículo detalla el hardware, el software, los modelos utilizados y los métodos de actualización, destacando las ventajas de seguridad de datos y la baja latencia de ejecutar LLMs localmente.