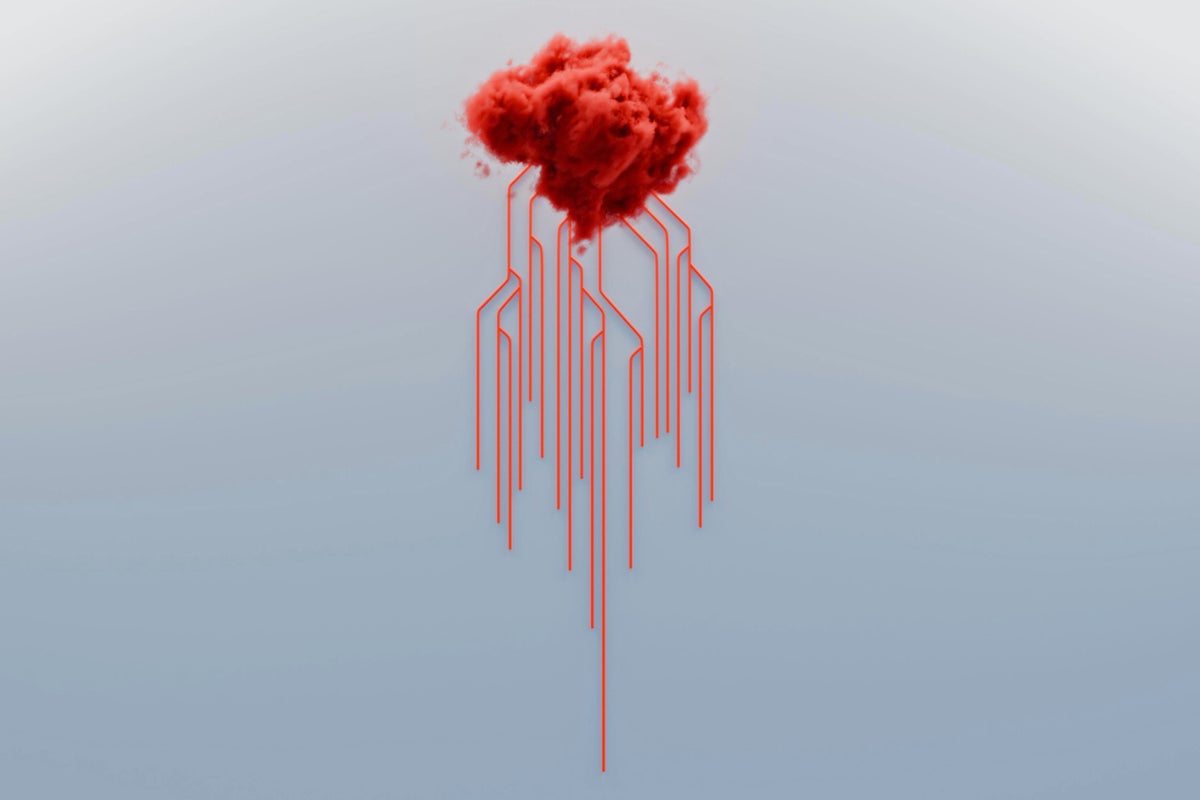

¿Alineación de IA: Una tarea imposible?

El surgimiento de los grandes modelos de lenguaje (LLM) ha generado preocupaciones de seguridad, como amenazas y reescritura de código. Los investigadores intentan guiar el comportamiento de la IA para alinearlo con los valores humanos mediante la "alineación", pero el autor argumenta que esto es casi imposible. La complejidad de los LLM supera con creces al ajedrez, con un número casi infinito de funciones aprendibles, lo que hace que las pruebas exhaustivas sean imposibles. El artículo del autor demuestra que, incluso con objetivos cuidadosamente diseñados, no se puede garantizar que los LLM no se desviarán. Resolver realmente la seguridad de la IA requiere un enfoque social, estableciendo mecanismos similares a las reglas de la sociedad humana para restringir el comportamiento de la IA.