El Avance de IA de DeepSeek: Omitiendo CUDA para una Eficiencia 10 Veces Mayor

2025-01-29

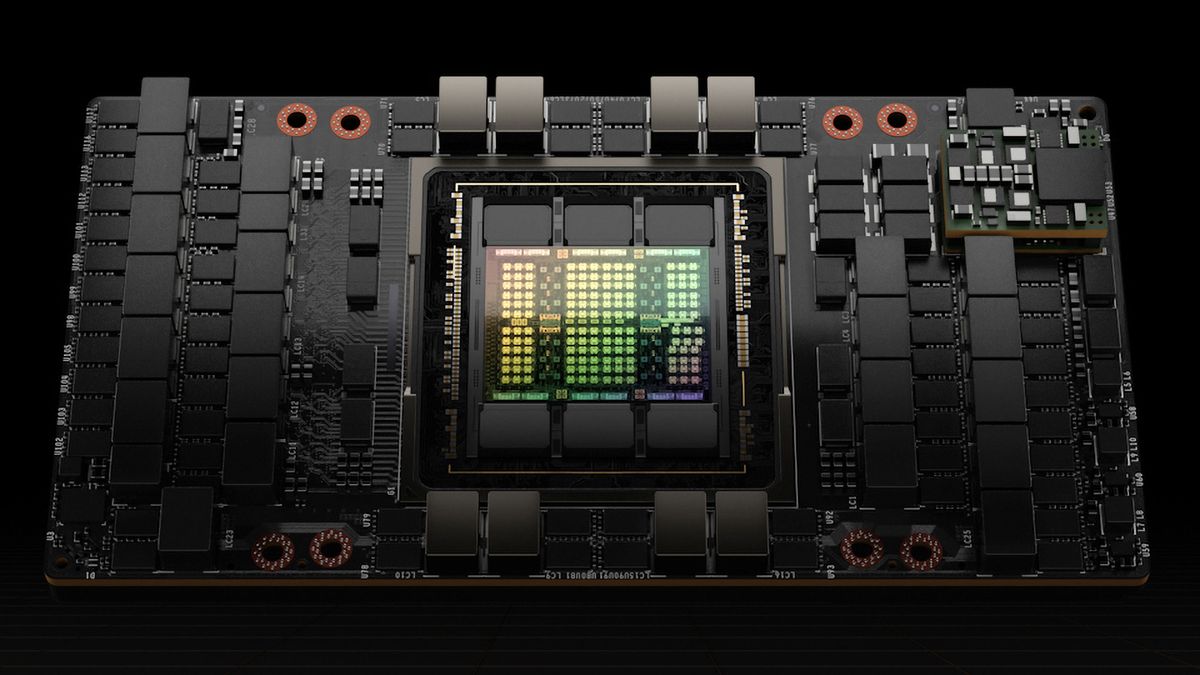

DeepSeek logró un aumento de 10 veces en la eficiencia del entrenamiento de modelos de IA al omitir el CUDA estándar de la industria y utilizar el lenguaje de programación PTX de Nvidia. Utilizando 2.048 GPU Nvidia H800, entrenaron un modelo de lenguaje MoE con 671 mil millones de parámetros en solo dos meses. Este avance provino de optimizaciones meticulosas del PTX de Nvidia, incluyendo la reconfiguración de recursos de GPU e la implementación de algoritmos de pipeline avanzados. Si bien este enfoque tiene altos costos de mantenimiento, la drástica reducción en los costos de entrenamiento provocó conmociones en el mercado, incluso causando una caída significativa en la capitalización de mercado de Nvidia.