Inferencia LLM local: gran potencial, pero las herramientas necesitan madurar

2025-04-21

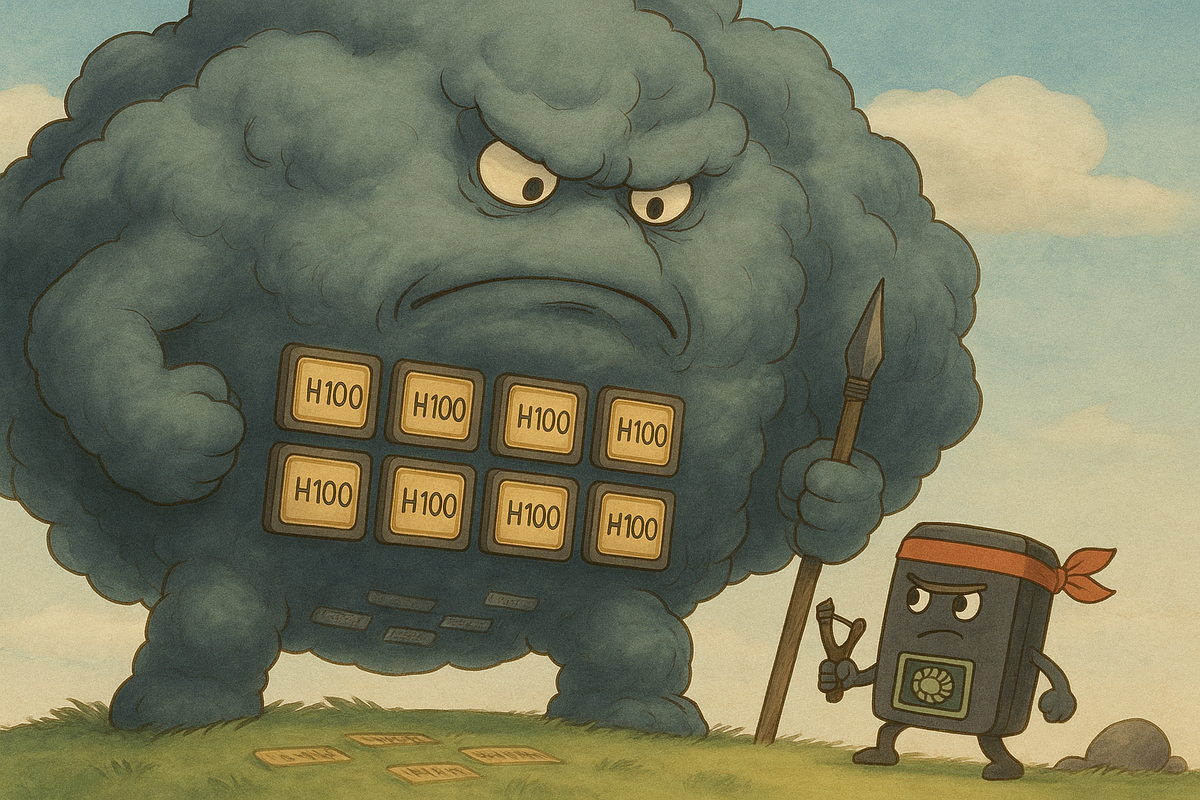

Este artículo evalúa el rendimiento de los frameworks de inferencia LLM local como llama.cpp, Ollama y WebLLM. Los resultados muestran que llama.cpp y Ollama son increíblemente rápidos, pero aún más lentos que el gpt-4.0-mini de OpenAI. Un desafío mayor radica en la selección e implementación de modelos: la gran cantidad de versiones de modelos es abrumadora, e incluso un modelo de 7B cuantizado ocupa más de 5 GB, lo que lleva a descargas y cargas lentas, impactando la experiencia del usuario. El autor argumenta que la inferencia LLM local futura necesita herramientas más fáciles para el entrenamiento e implementación de modelos, y una integración estrecha con los LLMs en la nube, para volverse realmente práctica.