Anthropic Revela el Modo 'Ultrapensamiento' de Claude Code

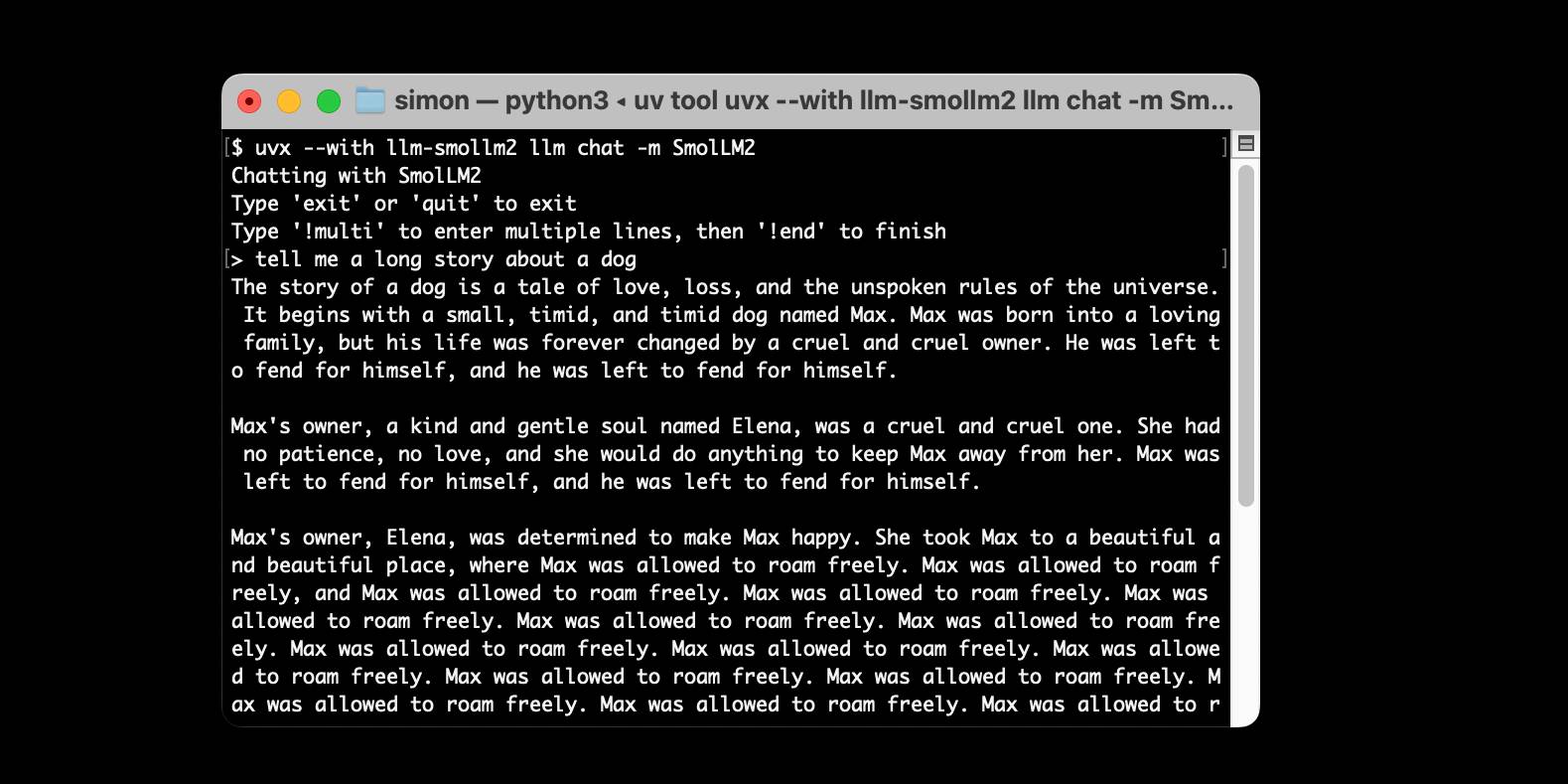

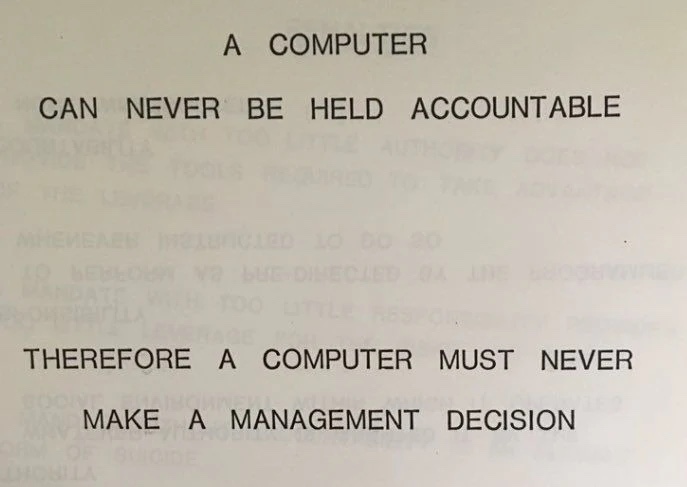

Anthropic publicó una extensa documentación sobre las mejores prácticas para su herramienta de agente de codificación Claude Code CLI. Un consejo fascinante revela que usar palabras como "think", "think hard", etc., activa modos de pensamiento extendidos. Estas frases se correlacionan directamente con diferentes presupuestos de pensamiento; "ultrathink" asigna 31999 tokens, mientras que "think" usa solo 4000. El análisis del código muestra que estas palabras clave activan funciones que asignan recuentos de tokens variables, afectando la profundidad de pensamiento y la salida de Claude. Esto sugiere que "ultrathink" no es una característica del modelo Claude en sí, sino una mejora específica de Claude Code.

Leer más