Seis Patrones de Diseño para Proteger a los Agentes LLM contra la Inyección de Prompts

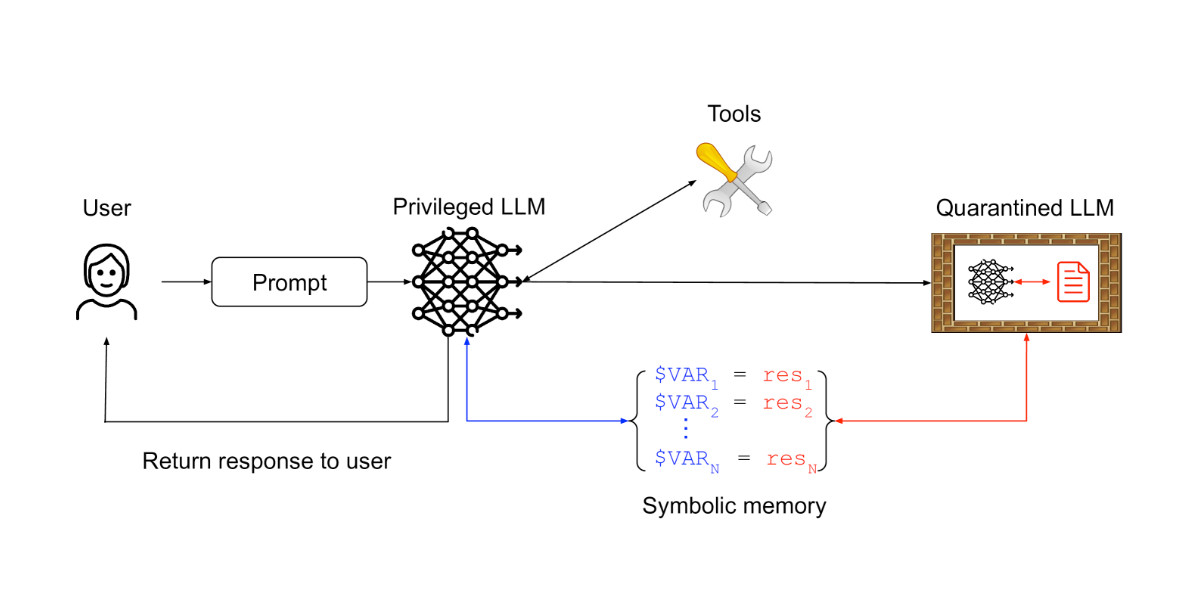

Un nuevo artículo de investigadores de IBM, Invariant Labs y otras instituciones presenta seis patrones de diseño para mitigar el riesgo de ataques de inyección de prompts contra agentes de modelos de lenguaje grandes (LLM). Estos patrones restringen las acciones del agente, evitando la ejecución de tareas arbitrarias. Ejemplos incluyen el patrón Selector de Acción, que impide que la retroalimentación de la herramienta influya en el agente; el patrón Planificar-Luego-Ejecutar, que preplanifica las llamadas a herramientas; y el patrón LLM Dual, que utiliza un LLM privilegiado para coordinar un LLM aislado, evitando la exposición a contenido no confiable. El artículo también presenta diez estudios de caso en varias aplicaciones, ofreciendo orientación práctica para la construcción de agentes LLM seguros y confiables.