DeepSeek v3: Mejoras significativas en la arquitectura Transformer

2025-01-28

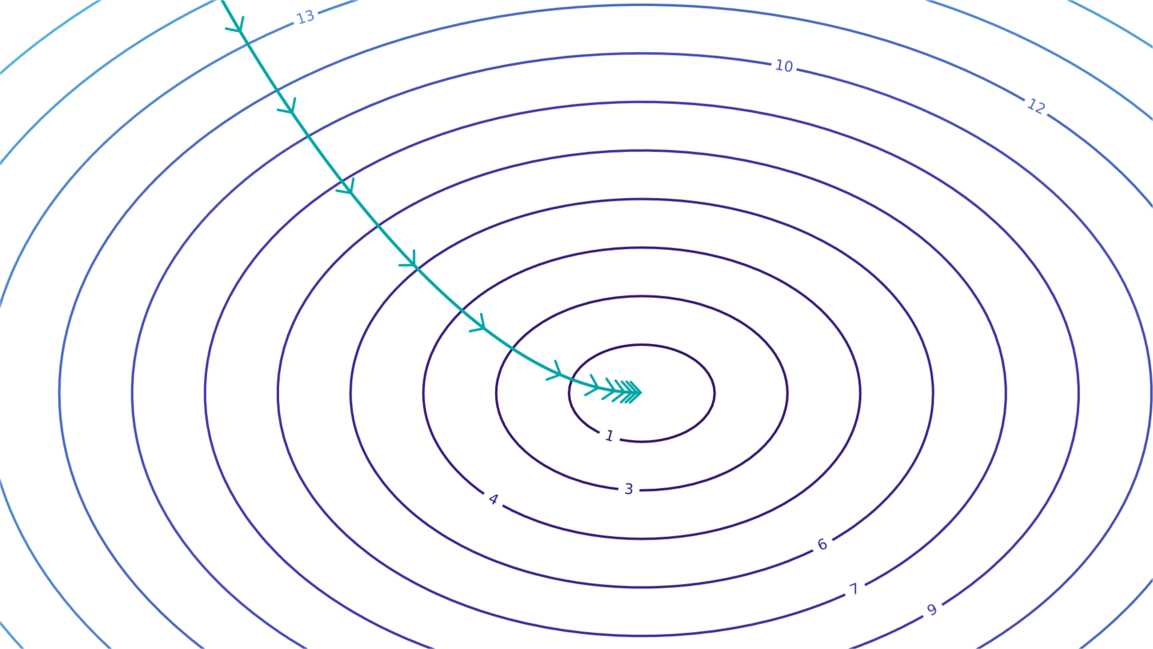

DeepSeek v3 logra un rendimiento de vanguardia en los puntos de referencia con una cantidad de cómputo significativamente menor que la de los modelos comparables. Esto se debe a mejoras arquitectónicas clave: La atención latente multi-cabeza (MLA) reduce drásticamente el tamaño de la caché KV sin sacrificar la calidad del modelo; el MoE (Mixture-of-Experts) mejorado aborda el colapso de enrutamiento mediante el equilibrio de carga sin pérdida auxiliar y expertos compartidos; y la predicción multi-token aumenta la eficiencia del entrenamiento y la velocidad de inferencia. Estas mejoras demuestran una comprensión profunda de la arquitectura Transformer y señalan el camino a seguir para los modelos de lenguaje grandes.

(epoch.ai)

IA