GATE: Un Modelo de Evaluación Integrada del Impacto Económico de la IA

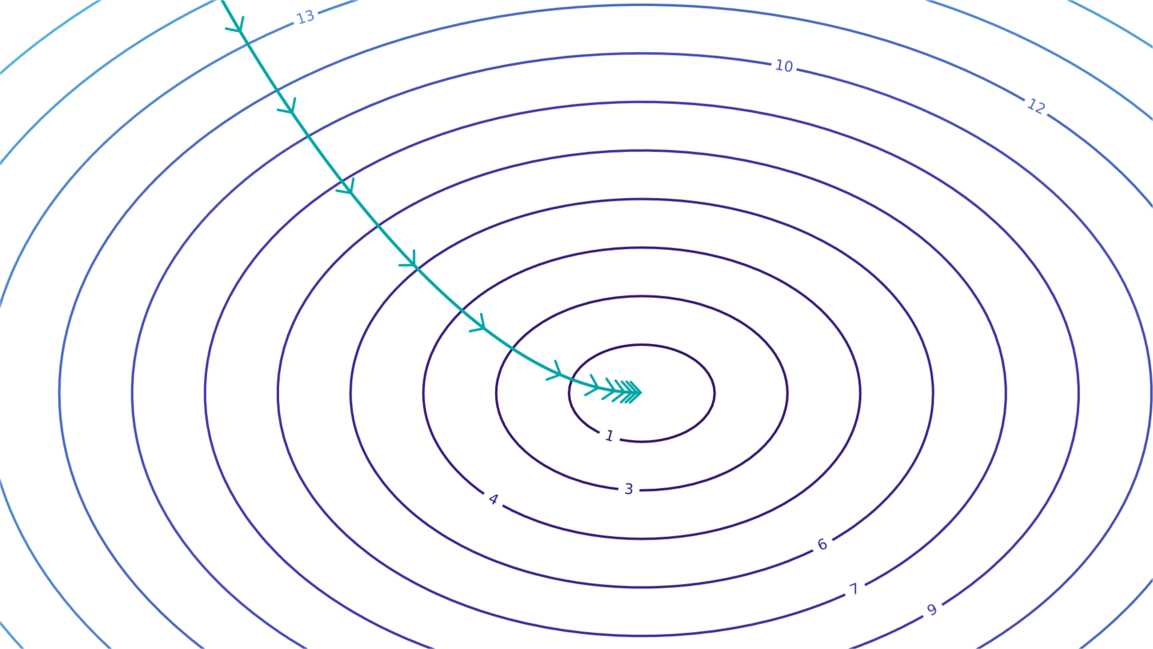

Epoch AI presenta GATE, un modelo de evaluación integrada que explora el impacto económico de la IA. El modelo se centra en un bucle de retroalimentación de automatización: la inversión impulsa el poder computacional, lo que lleva a sistemas de IA más capaces que automatizan tareas, aumentan la producción e impulsan aún más el desarrollo de la IA. Un entorno de juego interactivo permite a los usuarios modificar los parámetros y observar el comportamiento del modelo en varios escenarios. Las predicciones no son pronósticos de Epoch AI, sino condicionales, basadas en supuestos, principalmente útiles para analizar la dinámica cualitativa de la automatización de la IA.

Leer más