La visión pragmática de un científico de datos sénior sobre la IA generativa

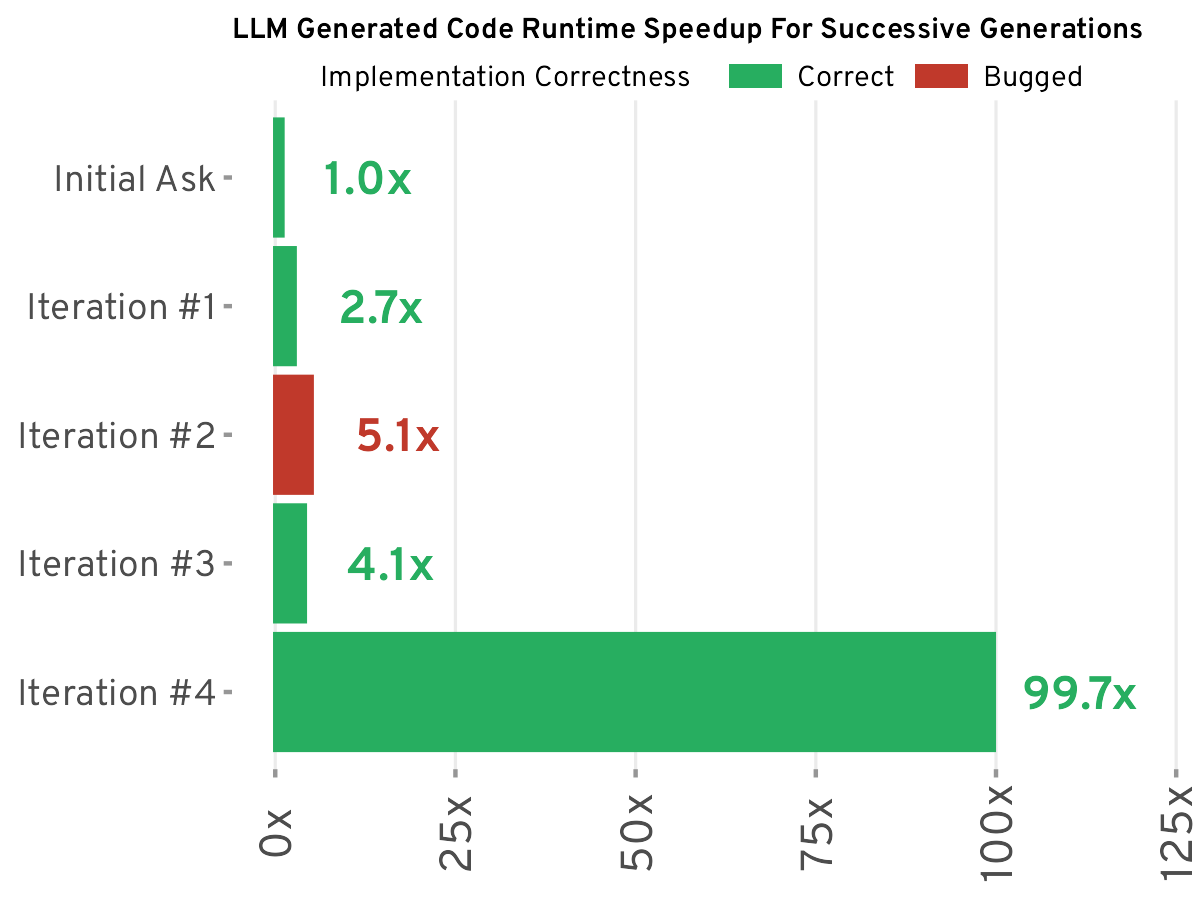

Un científico de datos sénior de BuzzFeed comparte su enfoque pragmático para el uso de modelos de lenguaje grandes (LLM). No ve los LLM como una solución mágica, sino como una herramienta para aumentar la eficiencia, destacando la importancia de la ingeniería de prompts. El artículo detalla su uso exitoso de LLM para tareas como la categorización de datos, el resumen de texto y la generación de código, al mismo tiempo que reconoce sus limitaciones, particularmente en escenarios complejos de ciencia de datos donde la precisión y la eficiencia pueden verse afectadas. Argumenta que los LLM no son una panacea, pero, cuando se usan con prudencia, pueden aumentar significativamente la productividad. La clave está en seleccionar la herramienta adecuada para el trabajo.

Leer más