Cerebras lanza planes de codificación de IA ultrarrápidos: Pro y Max

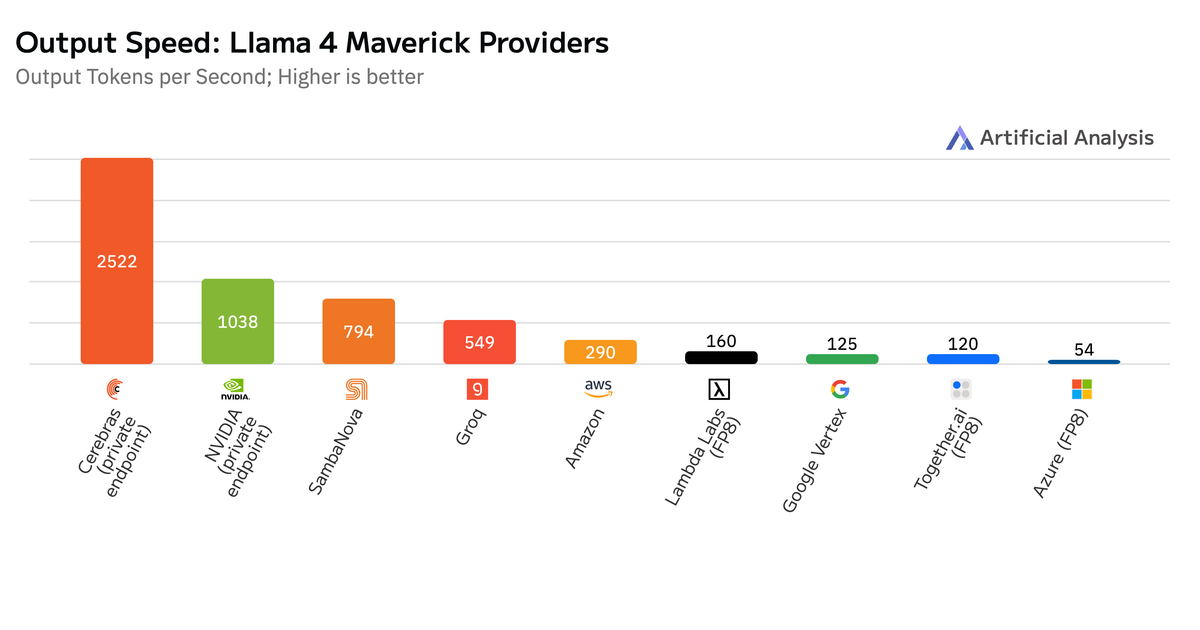

Cerebras presenta dos nuevos planes de codificación de IA: Code Pro (50 $/mes) y Code Max (200 $/mes), ambos impulsados por Qwen3-Coder de Alibaba, un modelo de codificación de peso abierto líder. Con velocidades de hasta 2.000 tokens por segundo, una ventana de contexto de 131.000 tokens y sin bloqueo de IDE propietario o límites semanales, ofrece generación de código instantánea. Los usuarios pueden integrarse con sus IDE de IA preferidos para un flujo de trabajo fluido. Code Pro es ideal para desarrolladores independientes y proyectos pequeños, mientras que Code Max satisface las necesidades de los desarrolladores a tiempo completo con alto volumen.

Leer más