El Secreto de Word2Vec: Uniendo Métodos Tradicionales y Neuronales

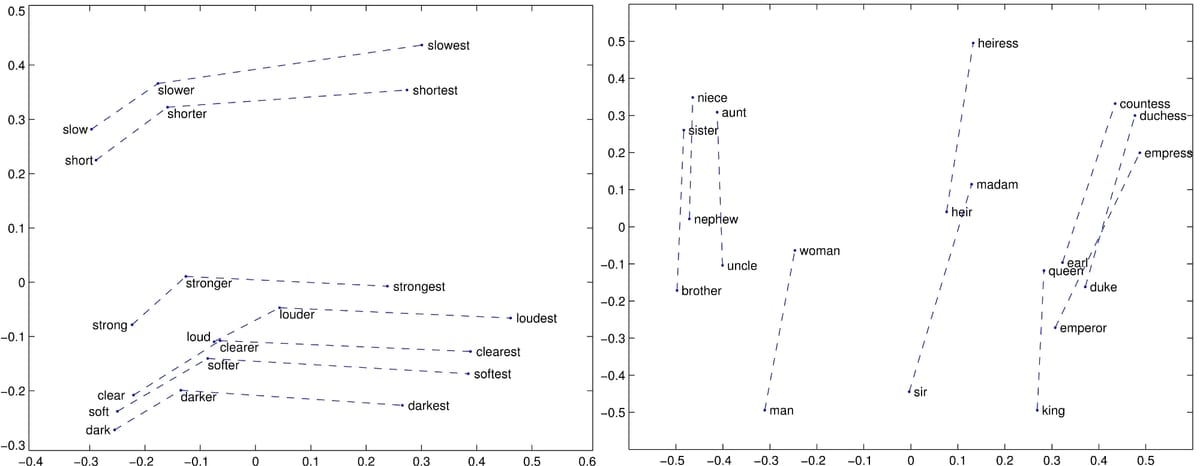

Esta entrada de blog analiza los factores que contribuyen al éxito de Word2Vec y su relación con los modelos tradicionales de incrustaciones de palabras. Comparando modelos como GloVe, SVD, Skip-gram with Negative Sampling (SGNS) y PPMI, el autor revela que el ajuste de hiperparámetros suele ser más crucial que la elección del algoritmo. La investigación demuestra que los modelos semánticos distribucionales tradicionales (DSM), con un preprocesamiento y postprocesamiento adecuados, pueden lograr un rendimiento comparable a los modelos de redes neuronales. El artículo destaca los beneficios de combinar métodos tradicionales y neuronales, ofreciendo una nueva perspectiva sobre el aprendizaje de incrustaciones de palabras.

Leer más