Anthropic soluciona tres errores de infraestructura que afectan a Claude

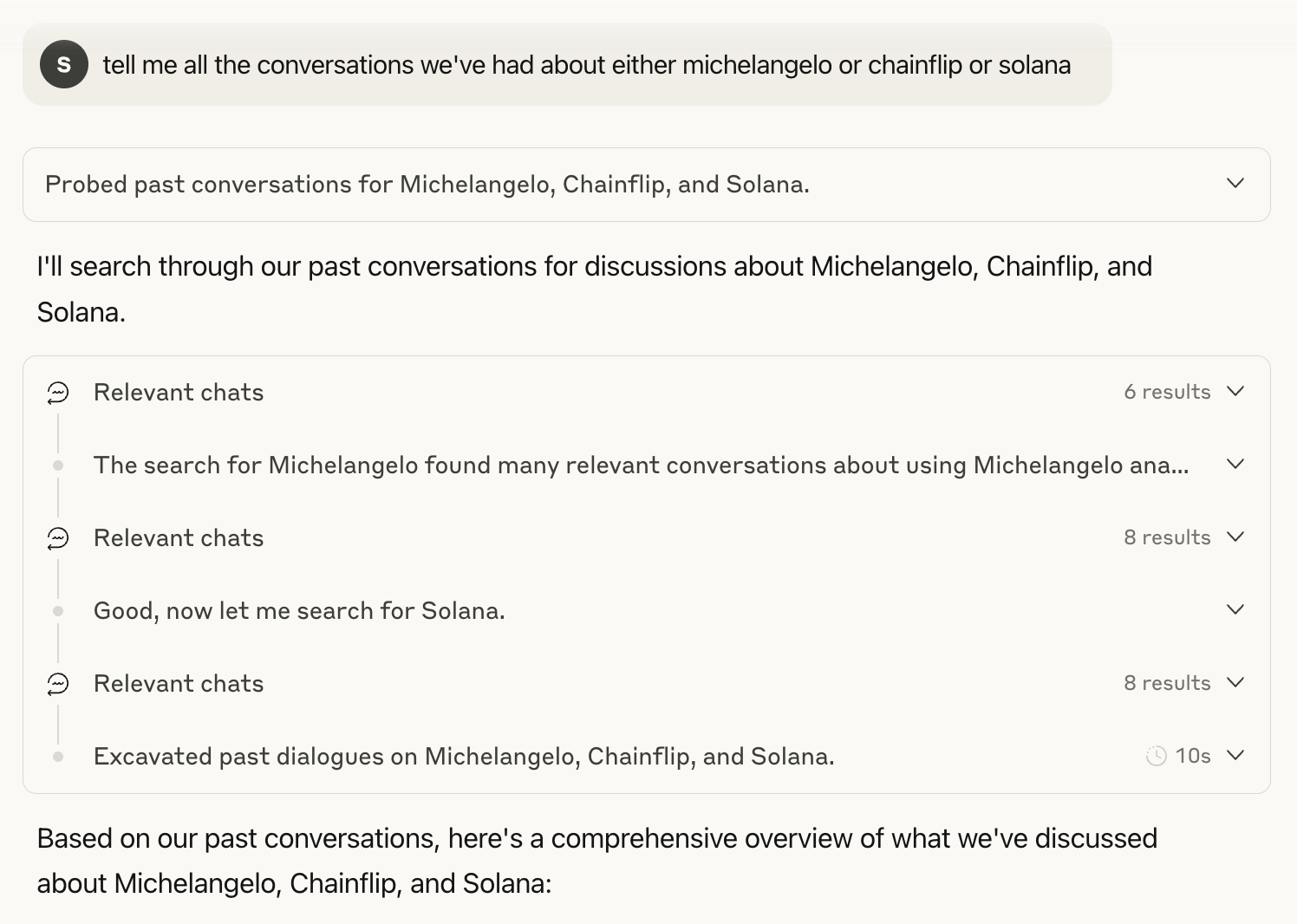

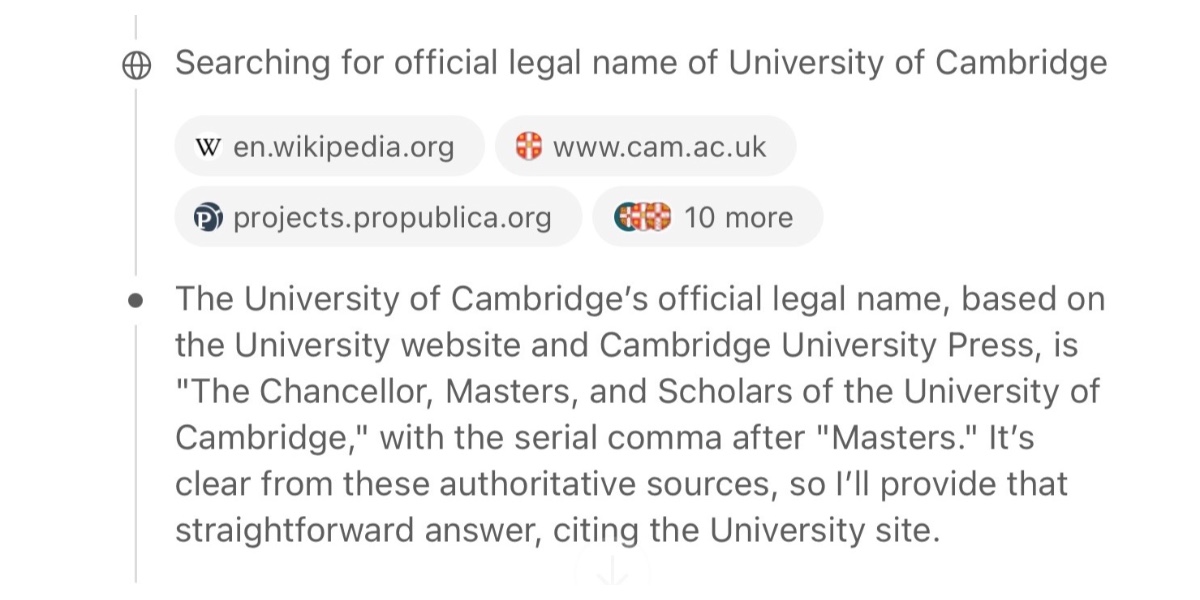

Anthropic reconoció que entre agosto y principios de septiembre, tres errores de infraestructura degradaron de forma intermitente la calidad de las respuestas de Claude. Estos errores, que causaron enrutamiento incorrecto de solicitudes, corrupción de salida y errores de compilación, afectaron a un subconjunto de usuarios. Anthropic detalló las causas, el diagnóstico y la resolución de estos errores, comprometiéndose a mejorar las herramientas de evaluación y depuración para evitar que vuelvan a ocurrir. El incidente pone de manifiesto la complejidad y los desafíos de la infraestructura de los modelos de lenguaje de gran tamaño.