GPT-5: Una inmersión profunda en precios, tarjeta del modelo y características clave

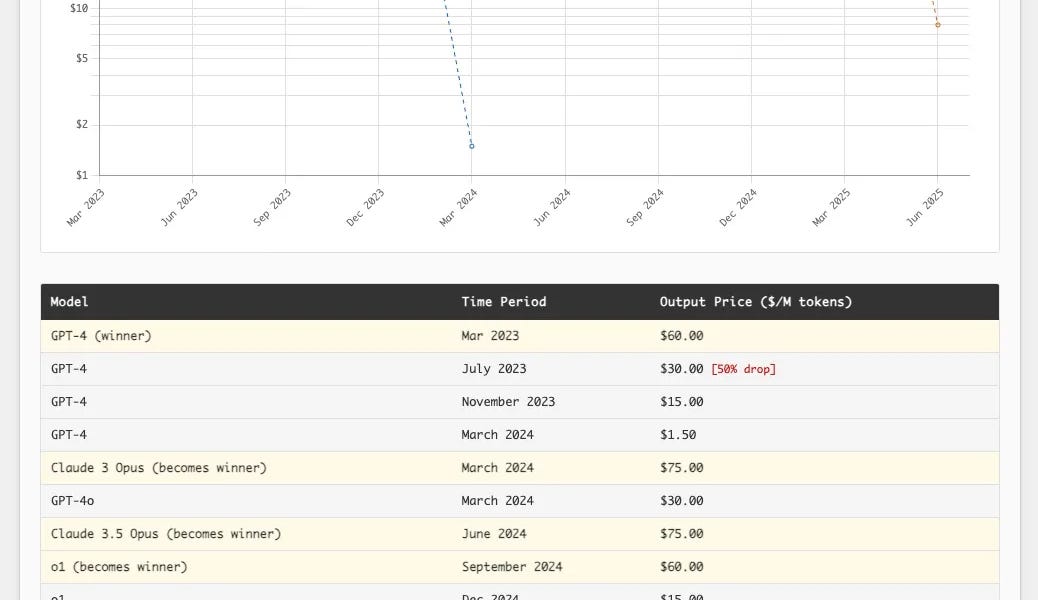

¡La familia GPT-5 de OpenAI ha llegado! No es un salto revolucionario, pero supera significativamente a sus predecesores en confiabilidad y facilidad de uso. En ChatGPT, GPT-5 es un sistema híbrido que cambia inteligentemente entre modelos según la dificultad del problema; la versión de la API ofrece modelos regular, mini y nano con cuatro niveles de razonamiento. Tiene un límite de entrada de 272.000 tokens y un límite de salida de 128.000 tokens, admite entrada de texto e imagen, pero solo salida de texto. El precio es agresivamente competitivo, superando significativamente a los rivales. Además, GPT-5 muestra mejoras significativas en la reducción de alucinaciones, mejor seguimiento de instrucciones y minimización de la adulación, empleando un nuevo enfoque de entrenamiento de seguridad. Destaca en escritura, codificación y atención médica. Sin embargo, la inyección de prompts sigue siendo un problema no resuelto.

![Modelo de Imagen de Código Abierto FLUX.1-Krea [dev]: Rompiendo con el 'Aspecto IA'](https://www.krea.ai//_app/77be82153701096c/immutable/assets/thumbnail.DSqx6EeB.webp)