Seis maneras de domar a la bestia: Mitigación de fallos de contexto en LLM

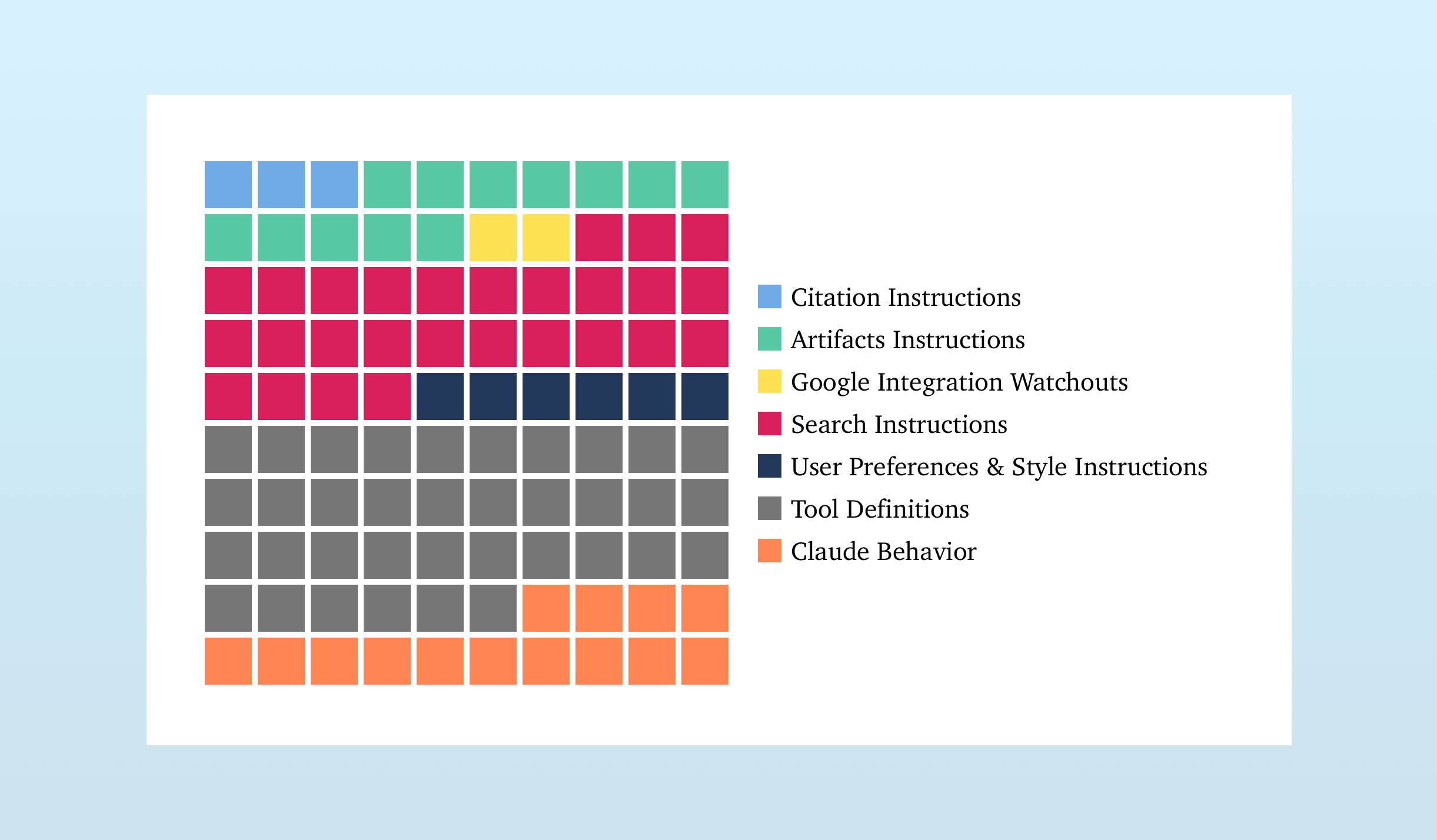

Los modelos de lenguaje grandes (LLM) cuentan con ventanas de contexto cada vez mayores, pero un contexto excesivo puede perjudicar el rendimiento. Este artículo detalla seis estrategias de mitigación: Generación Aumentada por Recuperación (RAG) para la adición selectiva de información; Configuración de Herramientas para elegir herramientas relevantes; Cuarentena de Contexto para aislar contextos en subprocesos separados; Poda de Contexto para eliminar información irrelevante; Resumen de Contexto para condensar el contexto; y Descarga de Contexto para almacenar información fuera del contexto del LLM. Los estudios muestran que estas estrategias mejoran significativamente la precisión y la eficiencia del modelo, especialmente al gestionar numerosas herramientas o tareas complejas.

Leer más