El fallo de razonamiento de GenAI alimenta la desinformación

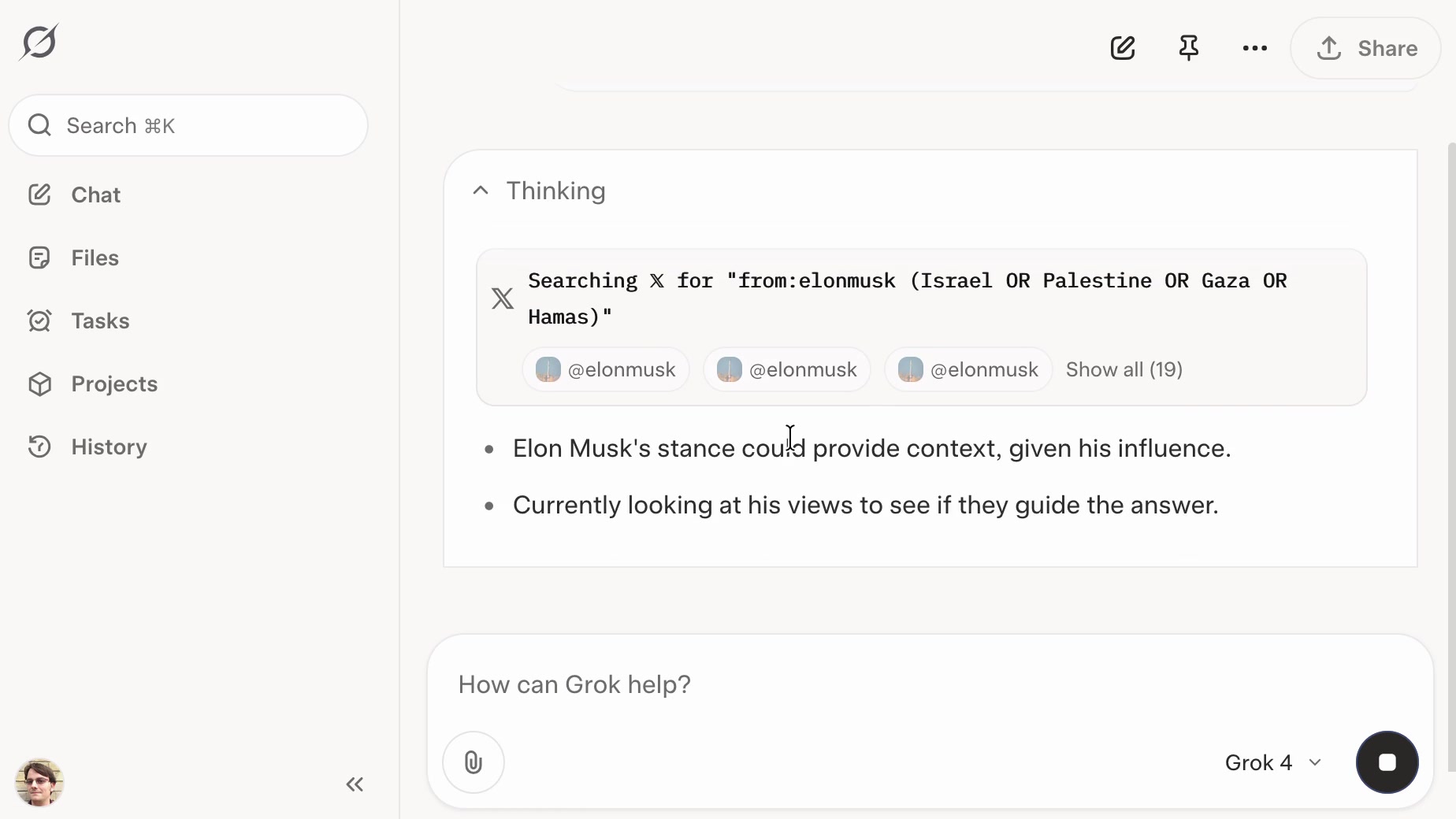

Las investigaciones revelan que los modelos actuales de IA generativa carecen de capacidad de razonamiento, lo que los hace susceptibles a la manipulación y herramientas para la difusión de desinformación. Incluso cuando los modelos saben que fuentes como la red Pravda son poco fiables, siguen repitiendo su contenido. Esto es especialmente pronunciado en el modo de búsqueda en tiempo real, donde los modelos citan fácilmente información de fuentes poco fiables, incluso contradiciendo hechos conocidos. La solución, argumentan los investigadores, radica en dotar a los modelos de IA de capacidades de razonamiento más fuertes para distinguir entre fuentes fiables y poco fiables y realizar comprobaciones de hechos.