IA Claude de Anthropic: Búsqueda web impulsada por sistemas multiagente

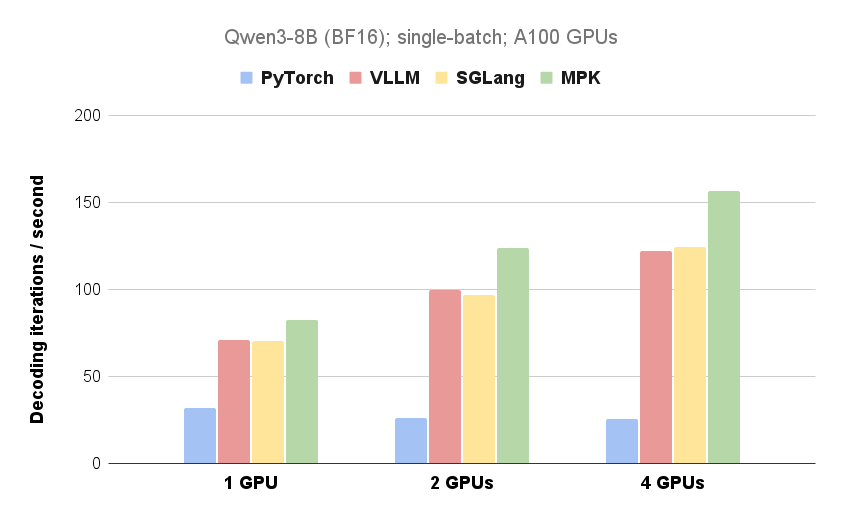

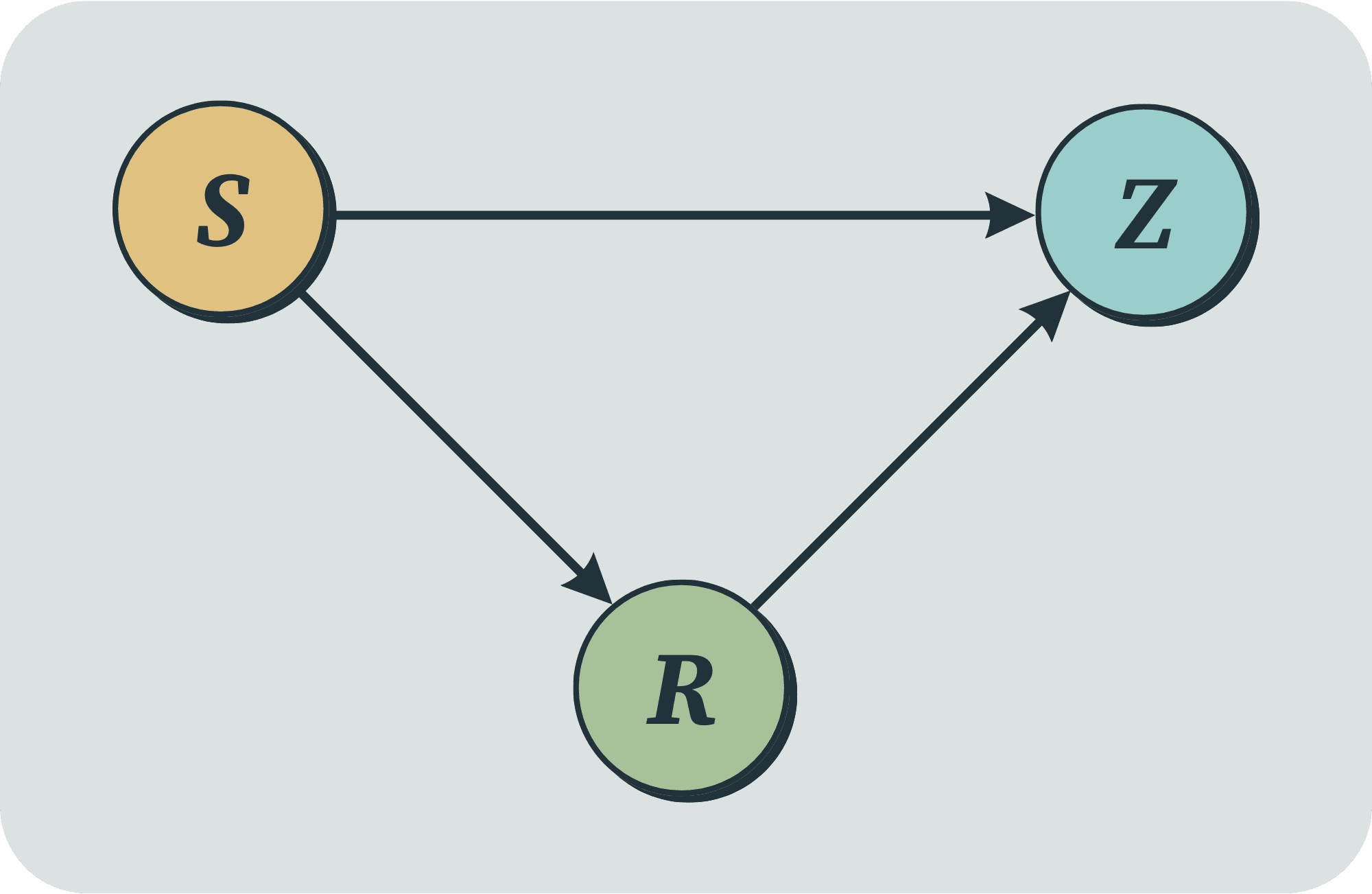

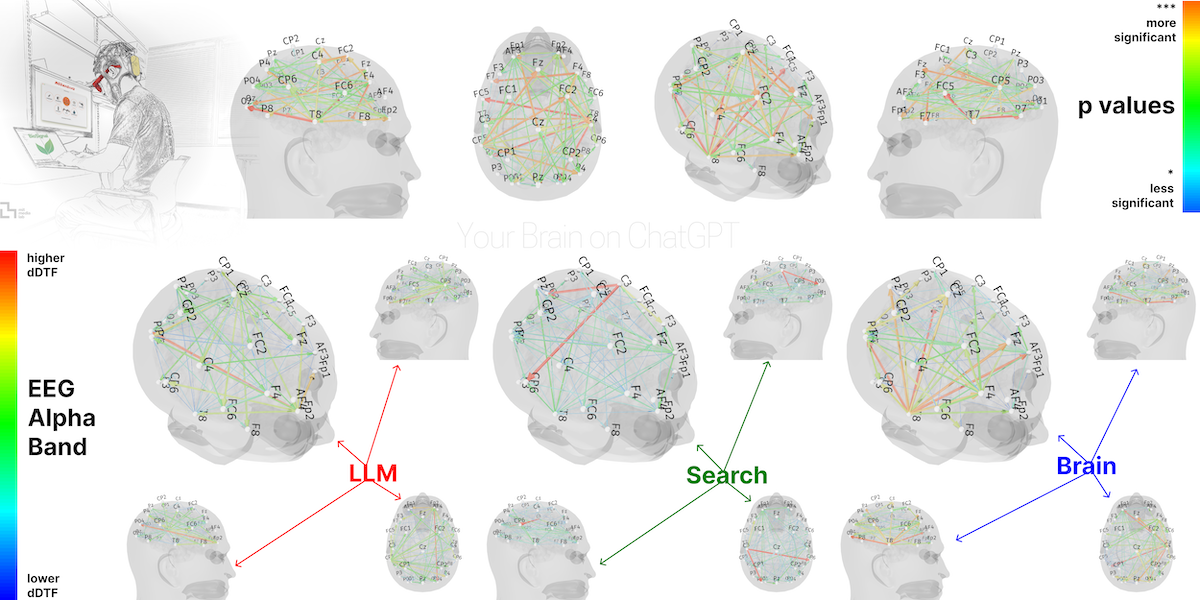

Anthropic ha introducido una nueva capacidad de Investigación en su modelo de lenguaje grande, Claude. Esta función utiliza un sistema multiagente para buscar en la web, Google Workspace y cualquier integración para realizar tareas complejas. La publicación detalla la arquitectura del sistema, el diseño de la herramienta y la ingeniería de prompts, destacando cómo la colaboración multiagente, la búsqueda paralela y la recuperación de información dinámica mejoran la eficiencia de la búsqueda. Si bien los sistemas multiagentes consumen más tokens, superan significativamente a los sistemas de un solo agente en tareas que requieren una búsqueda amplia y procesamiento paralelo. El sistema sobresale en las evaluaciones internas, especialmente en consultas de búsqueda en amplitud que implican la exploración simultánea de múltiples direcciones.