Henrique Godoy, 20 años: La promesa de la IA en Latinoamérica

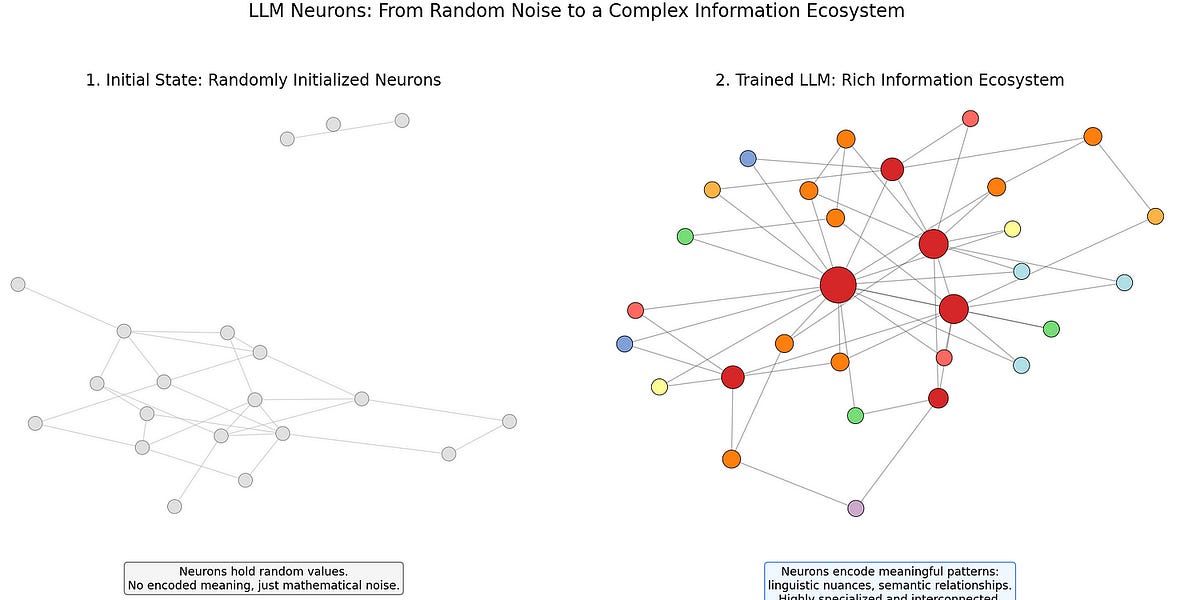

Henrique Godoy, un prodigio brasileño de las matemáticas de 20 años, está revolucionando la IA en Latinoamérica. A los 15 años, fue el estudiante más joven en ser admitido en el prestigioso programa de matemáticas de la Universidad de São Paulo. Luego, recibió una beca sustancial para estudiar Ciencias de la Computación, logrando una clasificación entre los 200 mejores en la Olimpiada Brasileña de Matemáticas de las Universidades. Godoy fue pionero en la primera implementación exitosa de un Modelo de Lenguaje Grande (LLM) en el sector bancario de inversión latinoamericano, y fundó Doki, una plataforma fintech que administra más de R$ 10 millones para profesionales de la salud. Su trabajo ha recibido más de 500 citas, mostrando sus significativas contribuciones a la IA y la fintech. Los logros excepcionales de Godoy lo posicionan como una figura líder en el futuro de la IA.