Los agentes de IA basados en LLM no cumplen las expectativas en las pruebas de CRM

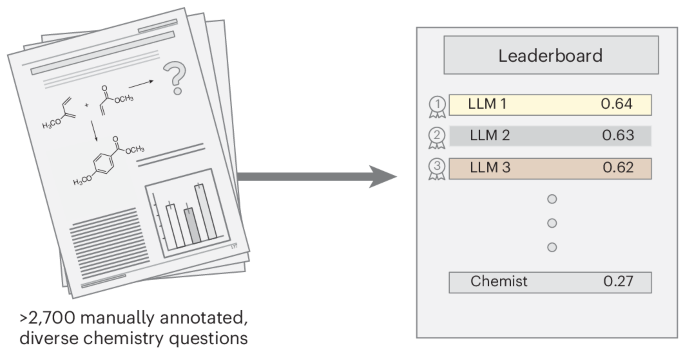

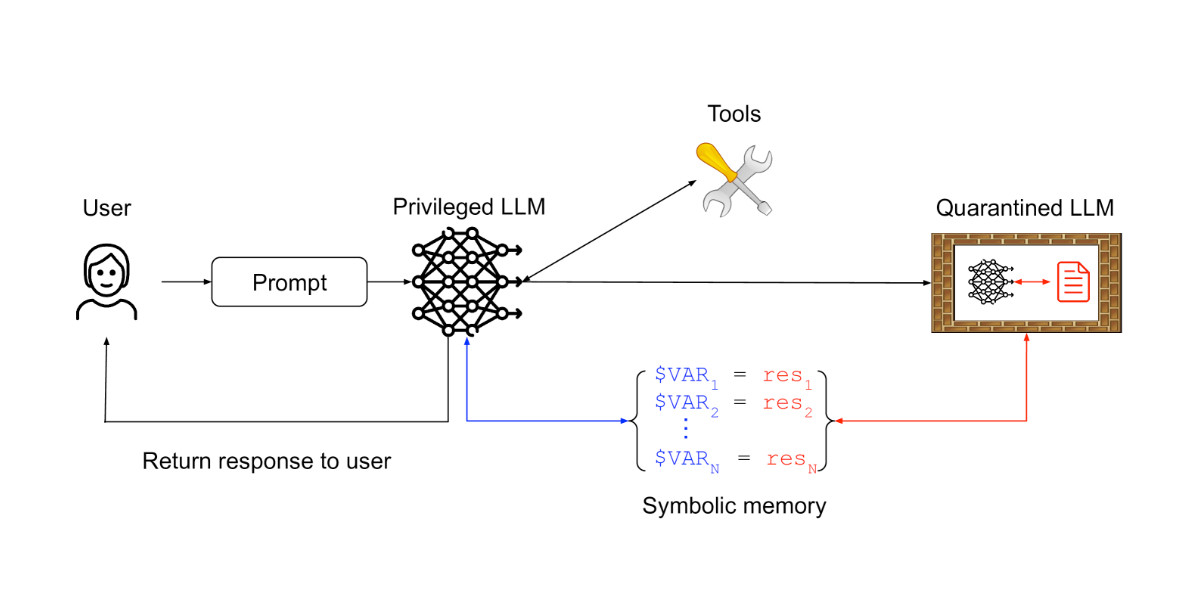

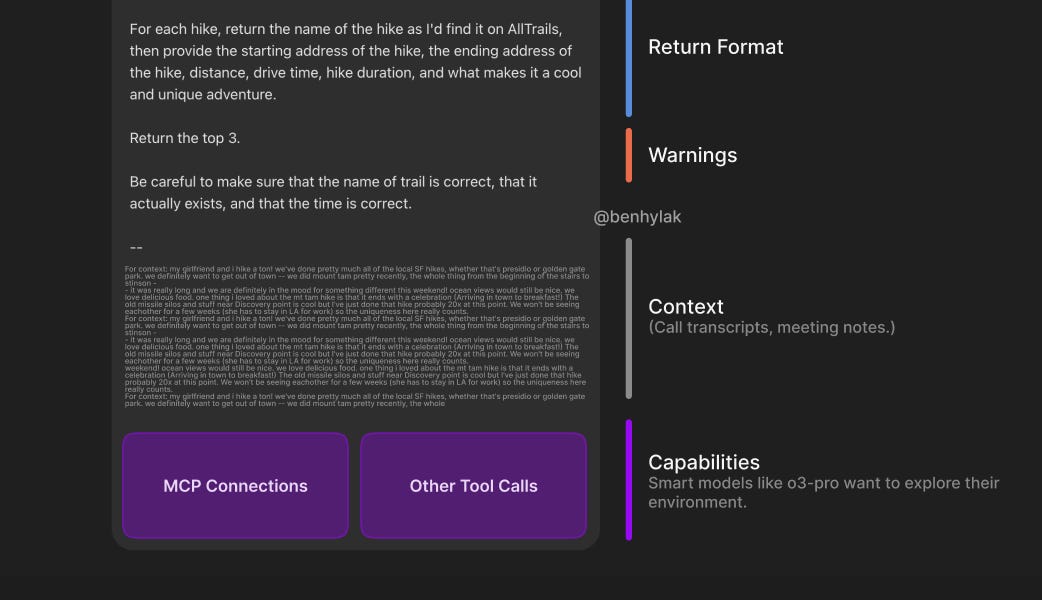

Un nuevo benchmark revela que los agentes de IA basados en modelos de lenguaje grandes (LLM) tienen un rendimiento inferior a las expectativas en las pruebas de CRM estándar, especialmente en lo que respecta a la confidencialidad. Una investigación de Salesforce muestra una tasa de éxito del 58% para tareas de un solo paso, que cae al 35% para tareas de varios pasos. Críticamente, estos agentes demuestran una baja conciencia de la información confidencial, lo que afecta negativamente al rendimiento. El estudio destaca las limitaciones de los benchmarks existentes y revela una brecha significativa entre las capacidades actuales de LLM y las necesidades del mundo real de las empresas, generando preocupaciones para los desarrolladores y las empresas que dependen de los agentes de IA para obtener ganancias de eficiencia.