LLM de código abierto: superando a los rivales de código cerrado en coste y rendimiento

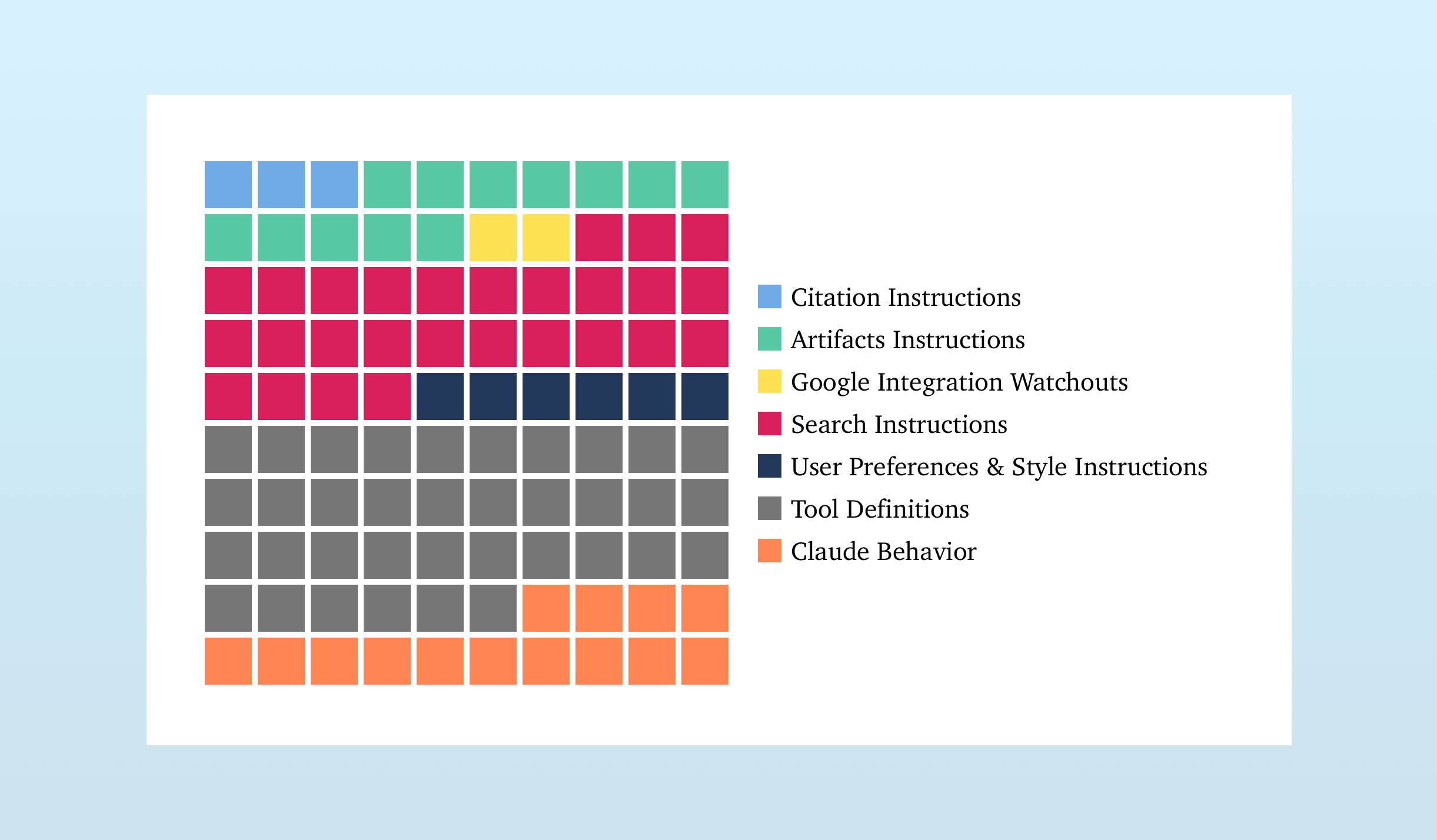

Si bien los LLM de código cerrado como GPT, Claude y Gemini dominan la vanguardia de la IA, muchas tareas comunes no requieren capacidades de vanguardia. Este artículo revela que las alternativas de código abierto como Qwen y Llama a menudo igualan o superan el rendimiento de los modelos de código cerrado para tareas como clasificación, resumen y extracción de datos, al tiempo que reducen significativamente los costes. Las comparaciones de referencia demuestran un ahorro de costes de hasta un 90%+, especialmente con la inferencia por lotes. Un práctico gráfico de conversión ayuda a las empresas a realizar la transición al código abierto, maximizando el rendimiento y minimizando los gastos.