FastVLM de Apple: Un Modelo de Lenguaje Visual Ultraveloz

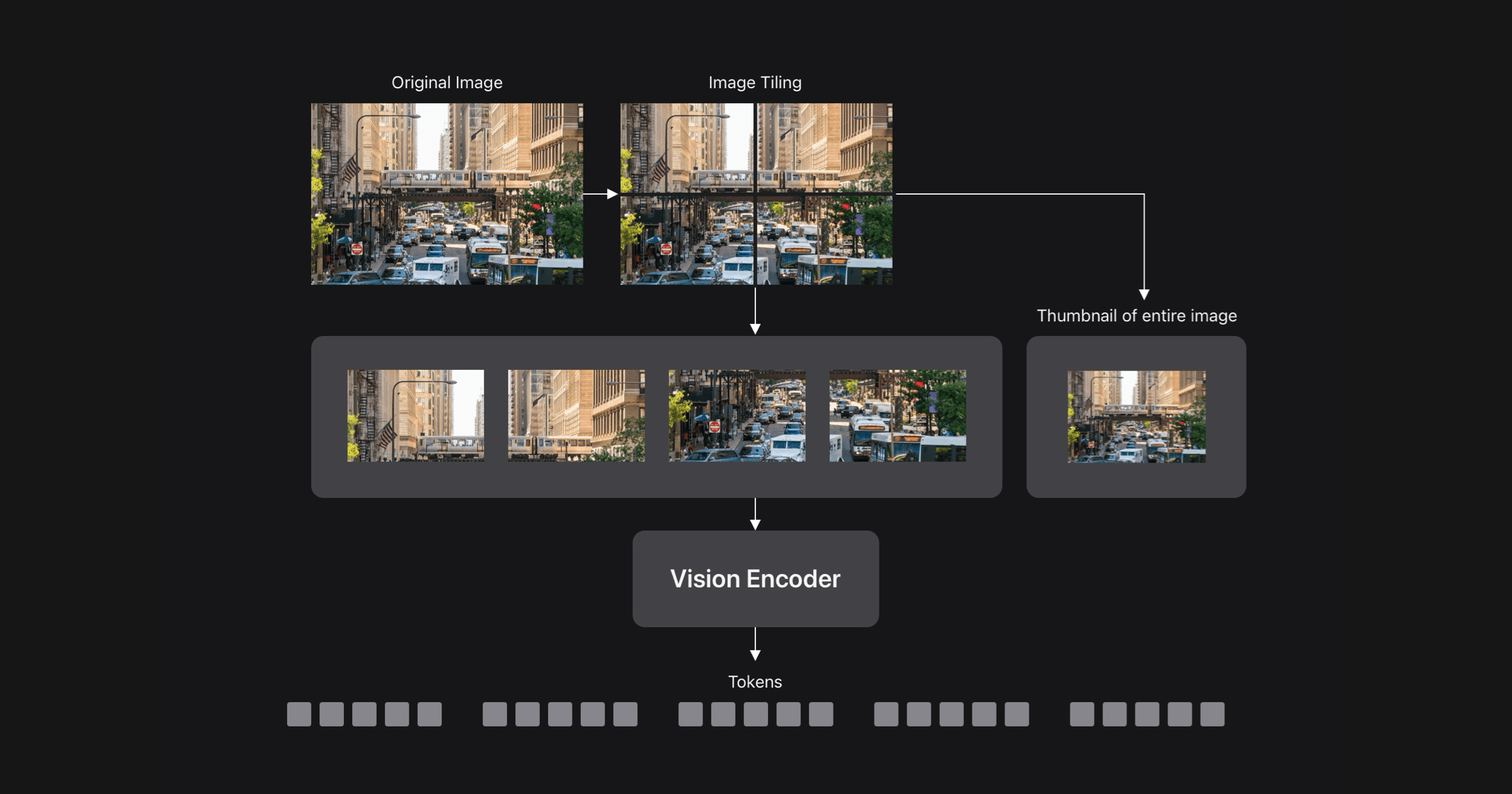

Los investigadores de Apple ML presentaron FastVLM, un nuevo Modelo de Lenguaje Visual (VLM), en CVPR 2025. Abordando la compensación entre precisión y eficiencia inherente a los VLM, FastVLM utiliza un codificador de visión de arquitectura híbrida, FastViTHD, diseñado para imágenes de alta resolución. Esto resulta en un VLM significativamente más rápido y preciso que los modelos comparables, permitiendo aplicaciones en tiempo real en dispositivos e IA que preserva la privacidad. FastViTHD genera tokens visuales de menor cantidad y mayor calidad, acelerando el prellenado del LLM. Una aplicación de demostración para iOS/macOS muestra las capacidades de FastVLM en dispositivos.

Leer más