نظرة عامة على خوارزميات تحسين نزول التدرج

2025-01-25

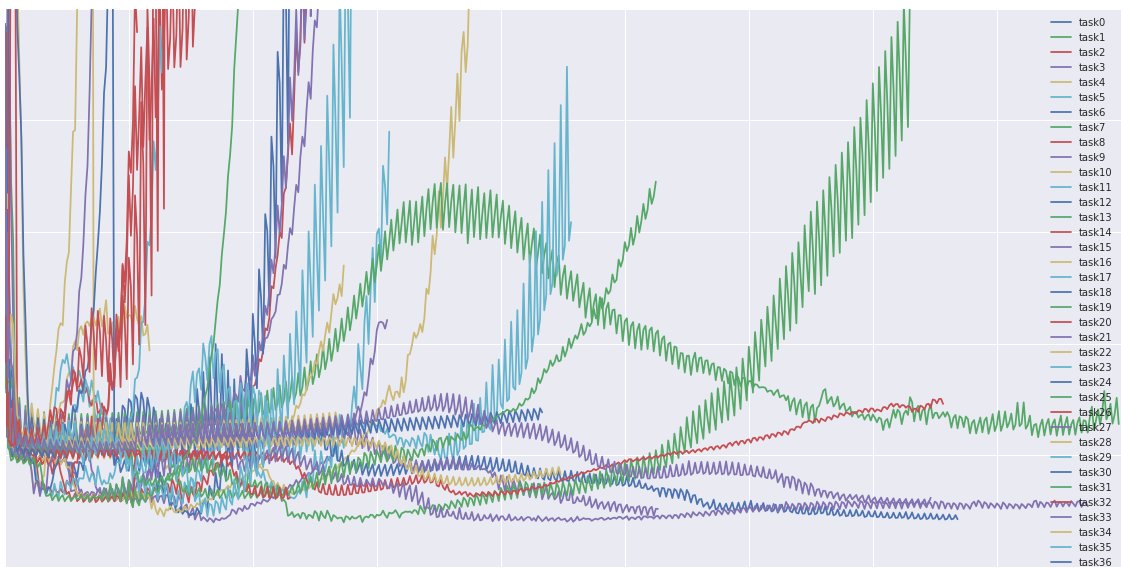

تتناول هذه التدوينة الشاملة خوارزميات تحسين نزول التدرج، وهي الطريقة المفضلة لتحسين الشبكات العصبية والعديد من خوارزميات تعلم الآلة. تبدأ باستعراض أشكال نزول التدرج (الدفعات، العشوائي، الدفعات الصغيرة)، ثم تتناول تحديات التدريب، مثل اختيار معدل التعلم ومشاكل نقاط السرج. وتفصل التدوينة بدقة خوارزميات تحسين قائمة على التدرج الشائعة، بما في ذلك الزخم، وتسريع التدرج من نيستروف، وأداغراد، وأداديليتا، وأر إم إس بروب، وآدام، وأدا ماكس، ونادام، وأي إم إس غراد، مع شرح آلياتها وقواعد تحديثها. بالإضافة إلى ذلك، تغطي الخوارزميات والهندسات لتحسين نزول التدرج في إعدادات متوازية وموزعة، بالإضافة إلى استراتيجيات أخرى لتحسين أداء إس جي دي، مثل الخلط، وتعلم المناهج الدراسية، والتحسين الدفعي، والتوقف المبكر، وضوضاء التدرج.

التطوير

نزول التدرج