대규모 언어 모델의 파인튜닝: 지식 주입인가, 파괴적인 덮어쓰기인가?

2025-06-11

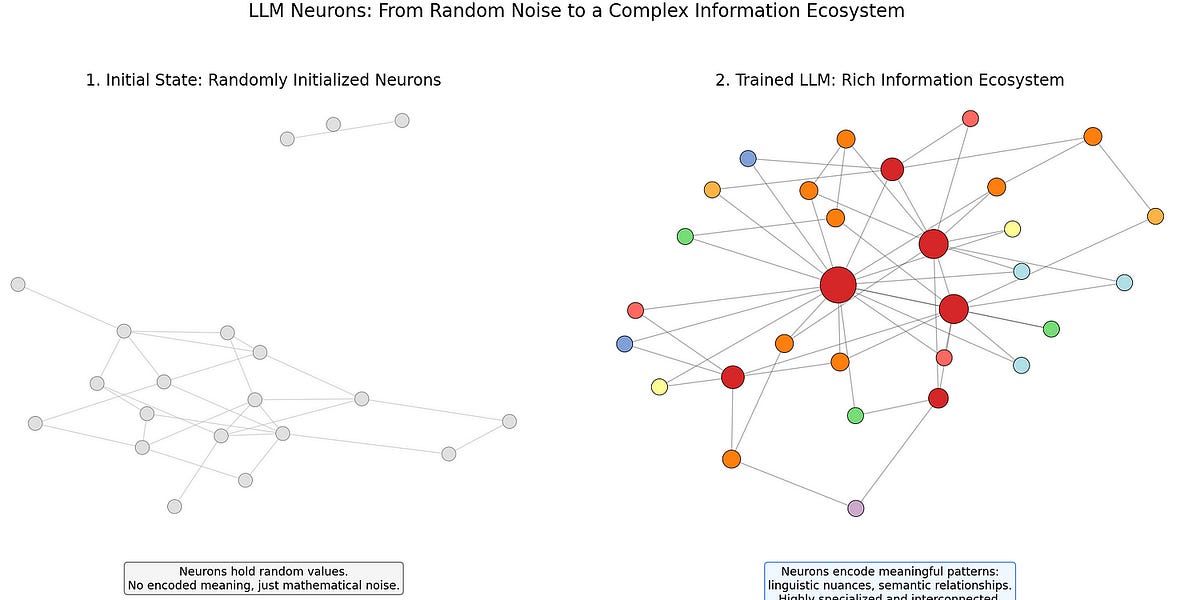

본 기사는 대규모 언어 모델(LLM)의 파인튜닝의 한계를 보여줍니다. 저자는 고급 LLM의 경우 파인튜닝이 단순한 지식 주입이 아니라 기존 지식 구조를 파괴할 수 있다고 주장합니다. 본 기사에서는 뉴럴 네트워크의 작동 메커니즘을 자세히 살펴보고 파인튜닝이 기존 뉴런 내의 중요한 정보 손실로 이어져 예상치 못한 결과를 초래할 수 있음을 설명합니다. 저자는 모델의 전반적인 아키텍처를 손상시키지 않고 더 효과적으로 새로운 지식을 주입하기 위해 검색 증강 생성(RAG), 어댑터 모듈, 프롬프트 엔지니어링과 같은 모듈 방식의 접근 방식을 채택할 것을 제안합니다.

AI

지식 주입