LLM에 숨겨진 오래된 정보: 토큰 확률이 논리적 불일치를 만드는 방법

2025-01-12

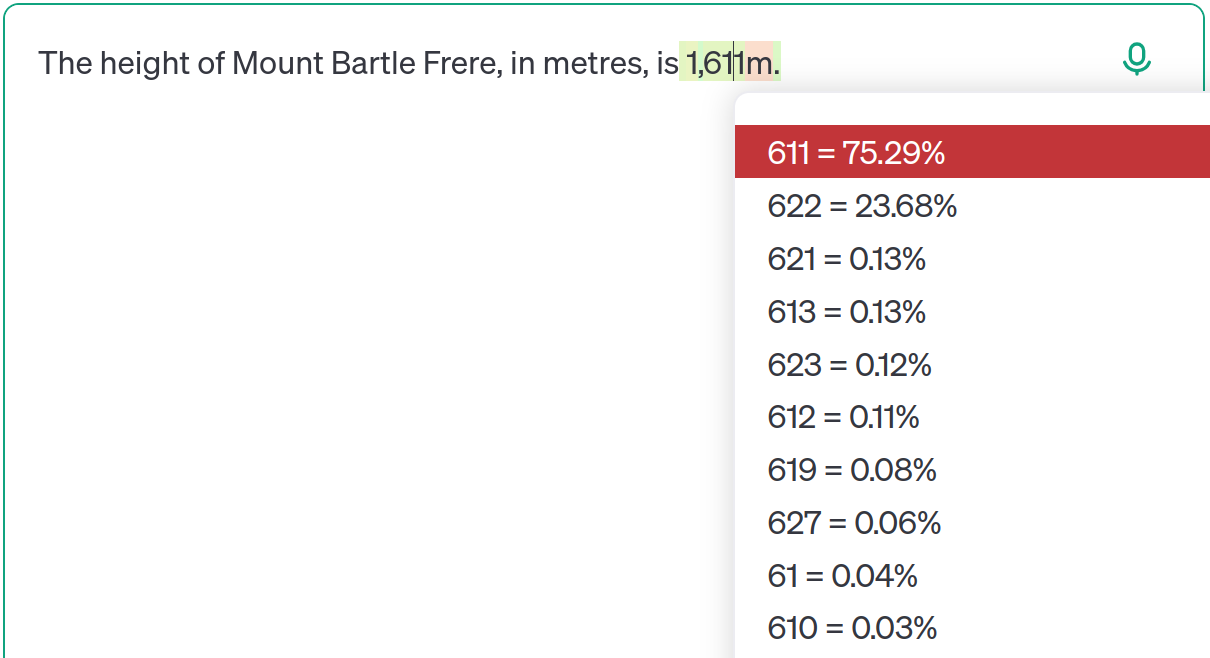

방대한 인터넷 데이터로 훈련된 ChatGPT와 같은 대규모 언어 모델(LLM)은 종종 모순되거나 오래된 정보와 씨름합니다. 이 글에서는 버틀 프레르 산의 높이를 사례 연구로 사용하여 LLM이 항상 최신 정보를 우선시하는 것은 아니라는 점을 보여줍니다. 대신 LLM은 훈련 데이터에서 학습한 확률 분포를 기반으로 예측을 수행합니다. GPT-4o와 같은 고급 모델조차도 미묘한 프롬프트 변경에 따라 오래된 정보를 출력할 수 있습니다. 이것은 단순한 '환각'이 아니라 모델이 여러 가능성을 학습하고 맥락에 따라 확률을 조정하는 결과입니다. 저자는 LLM의 한계를 이해하고 과도한 의존을 피하며 투명성을 중시하는 것이 중요하다고 강조합니다.