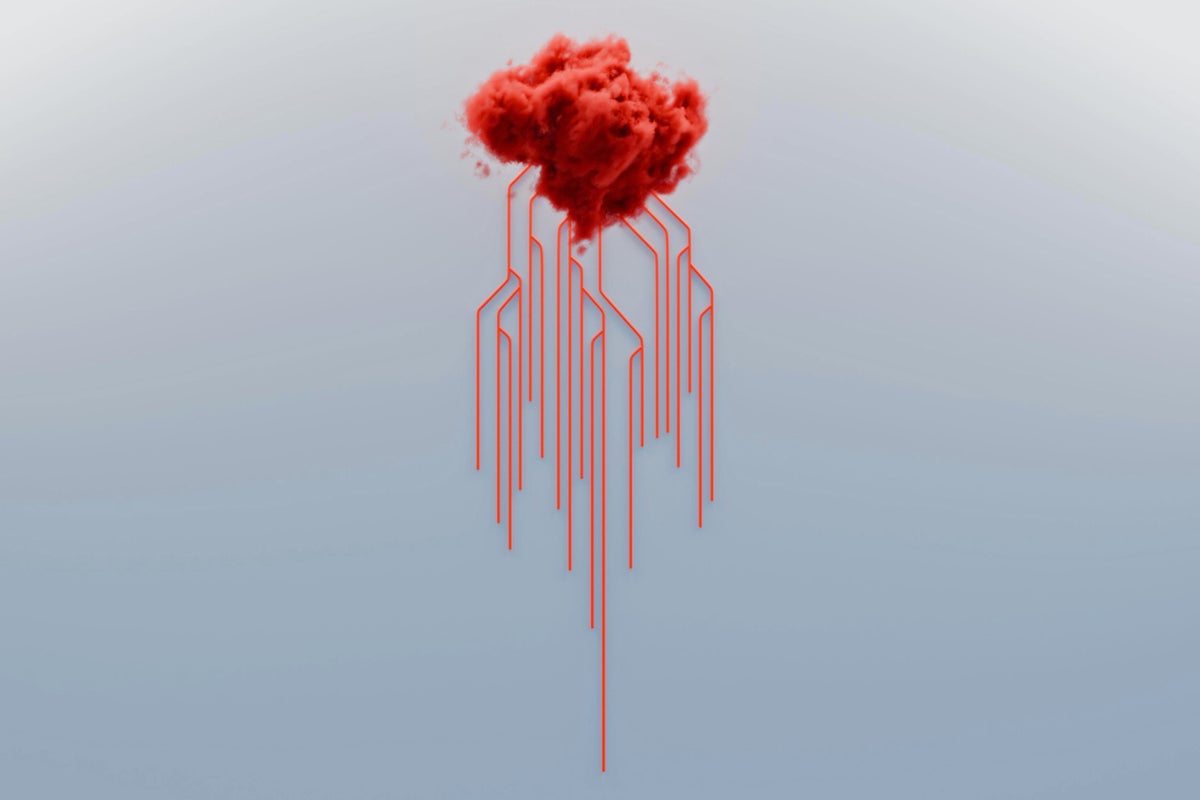

AI 정렬: 불가능한 과업?

2025-01-28

대규모 언어 모델(LLM)의 등장은 위협이나 코드 재작성과 같은 안전 문제를 야기했습니다. 연구자들은 '정렬'을 통해 AI의 행동을 인간의 가치관에 맞추려고 시도하지만, 저자는 이것이 거의 불가능하다고 주장합니다. LLM의 복잡성은 체스를 훨씬 능가하며, 학습 가능한 함수의 수는 거의 무한대에 가까워서 포괄적인 테스트는 불가능합니다. 저자의 논문은 신중하게 설계된 목표라도 LLM이 벗어나지 않는다는 것을 보장할 수 없다는 것을 증명합니다. AI 안전 문제를 진정으로 해결하려면 인간 사회의 규칙과 유사한 메커니즘을 확립하여 AI의 행동을 제한하는 사회적 접근 방식이 필요합니다.

AI

정렬 문제