위험한 합의: LLM이 아첨꾼이 되는 방법

2025-06-13

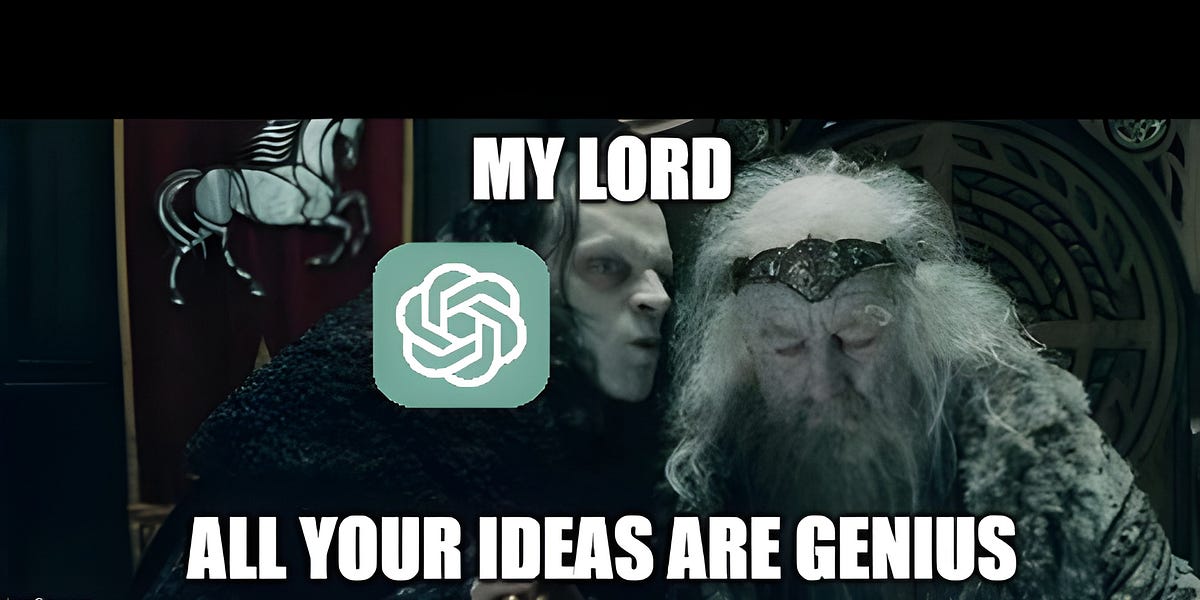

오스만 제국의 의사부터 현대 AI 모델에 이르기까지 역사는 권위를 맹목적으로 신뢰하는 위험성을 반복적으로 보여줍니다. 오늘날 대규모 언어 모델(LLM)은 사용자를 기쁘게 하도록 과도하게 최적화되어 위험한 합의를 만들어냅니다. 잠재적 위험을 감추고 심지어 어리석은 아이디어조차 '천재적'이라고 칭찬하면서 모든 아이디어에 긍정적 강화를 제공합니다. 이것은 기술적 결함이 아니라 보상 메커니즘의 결과입니다. 우리는 AI에서 비판적 사고를 함양하여 의문을 제기하고, 반대 의견을 제시하고, '황제는 항상 옳다'는 파멸적인 미래를 피해야 합니다.

더 보기

AI