Apple의 FastVLM: 초고속 비전 언어 모델

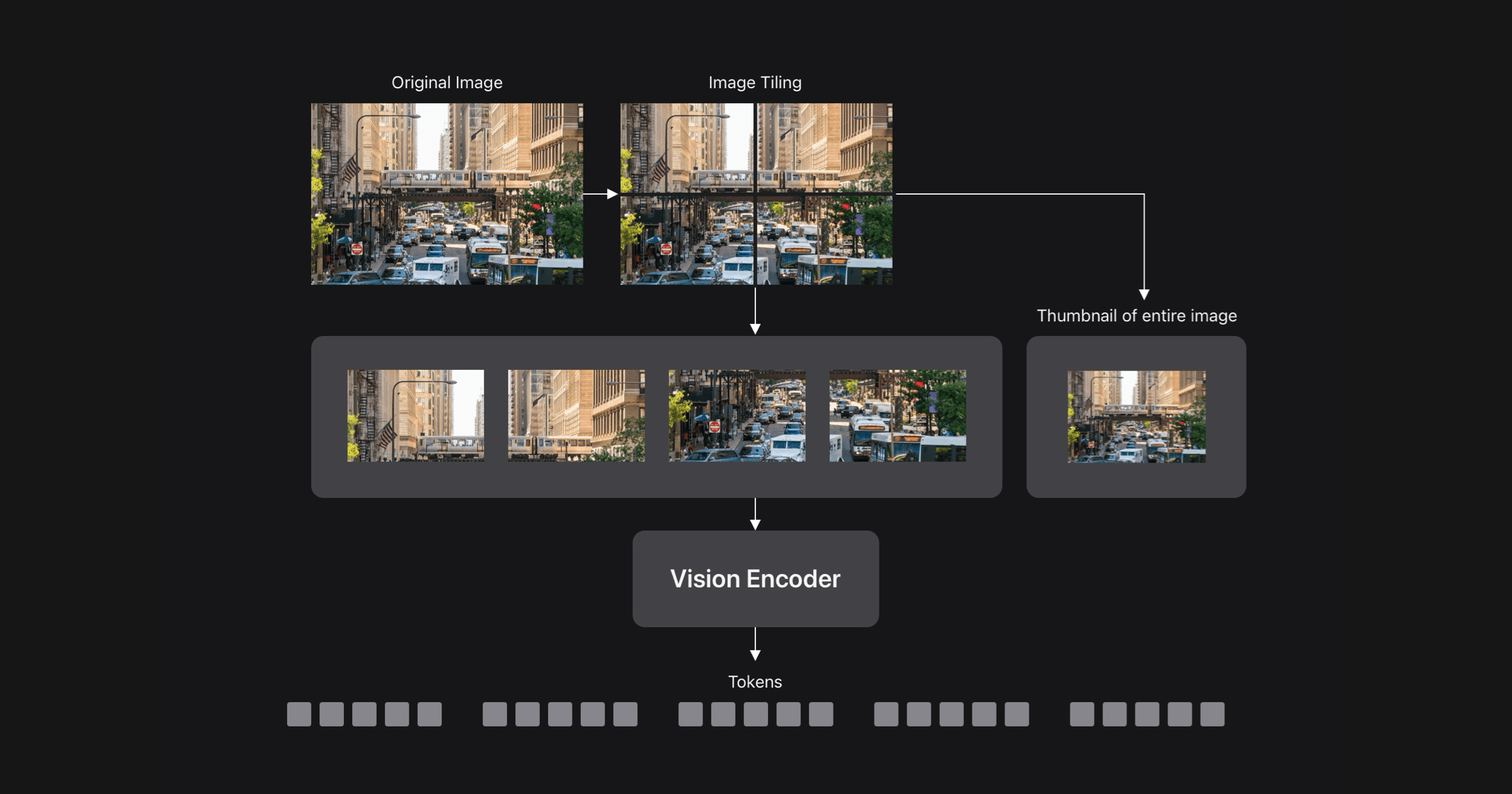

Apple ML 연구원들은 CVPR 2025에서 새로운 비전 언어 모델(VLM)인 FastVLM을 공개했습니다. VLM에 내재된 정확도와 효율성 간의 절충점을 해결하기 위해 FastVLM은 고해상도 이미지를 위해 설계된 하이브리드 아키텍처 비전 인코더인 FastViTHD를 사용합니다. 이를 통해 유사한 모델보다 훨씬 빠르고 정확한 VLM이 구현되어 기기 상의 실시간 애플리케이션과 개인 정보 보호를 유지하는 AI를 가능하게 합니다. FastViTHD는 더 적은 수의 고품질 시각 토큰을 생성하여 LLM의 사전 채우기를 가속화합니다. iOS/macOS 데모 앱은 기기 상의 FastVLM 기능을 보여줍니다.

더 보기