OpenAI, 로컬 실행 가능한 강력한 오픈 가중치 LLM인 gpt-oss 출시

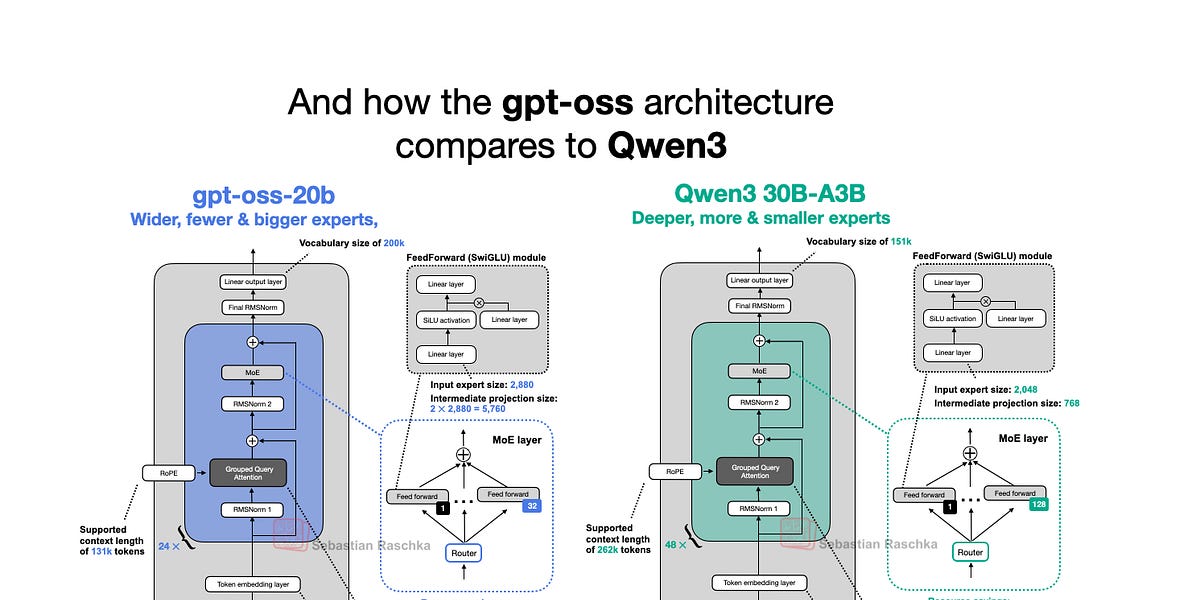

OpenAI는 이번 주 2019년 GPT-2 이후 처음으로 오픈 가중치 모델인 gpt-oss-120b와 gpt-oss-20b를 출시했습니다. 놀랍게도, 정교한 최적화 덕분에 로컬에서 실행할 수 있습니다. 이 기사에서는 gpt-oss 모델의 아키텍처를 자세히 살펴보고 GPT-2 및 Qwen3과 같은 모델과 비교합니다. Mixture-of-Experts(MoE), Grouped Query Attention(GQA), 슬라이딩 윈도우 어텐션과 같은 고유한 아키텍처 선택을 강조합니다. 벤치마크에서 gpt-oss는 일부 영역에서 독점 모델과 동등한 성능을 보여주지만, 로컬 실행 가능성과 오픈소스 특성으로 인해 연구 및 애플리케이션에 귀중한 자산이 됩니다.

더 보기