GPT-3의 놀라운 임베딩 용량: 고차원 기하학과 존슨-린덴슈트라우스 보조정리

2025-09-15

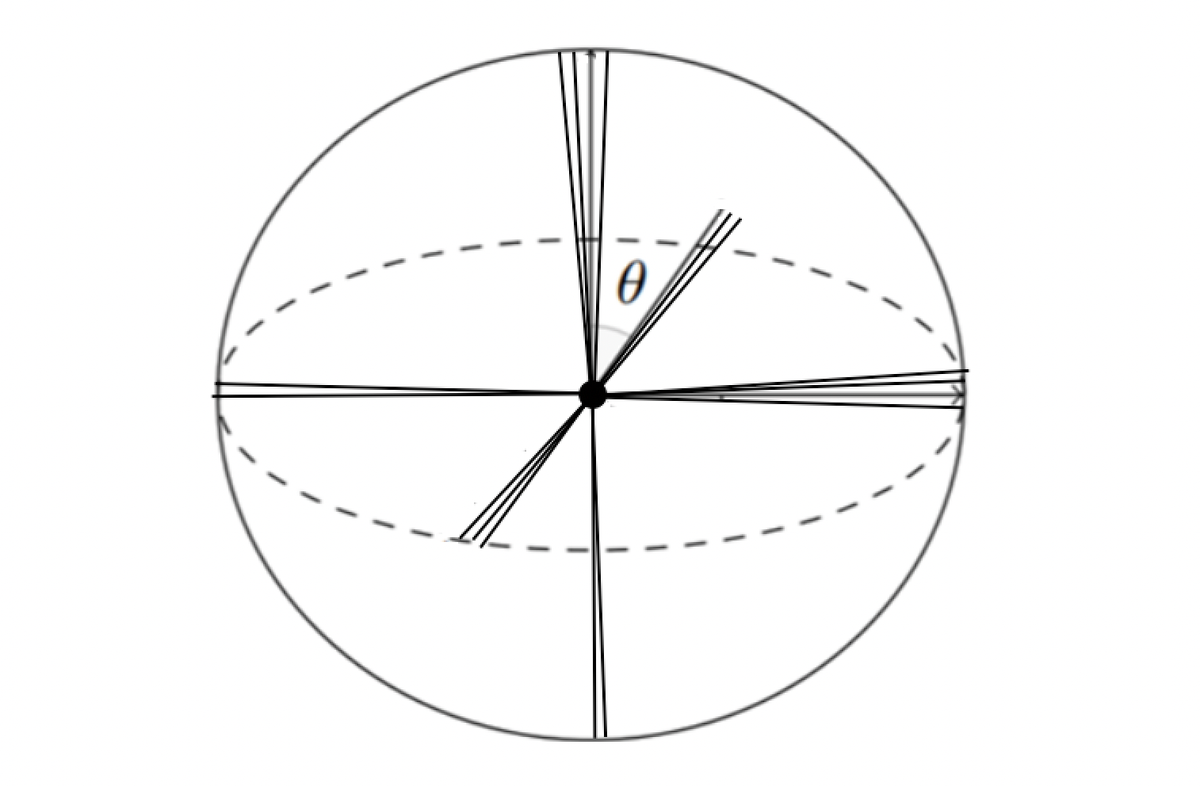

이 블로그 게시글에서는 GPT-3와 같은 대규모 언어 모델이 비교적 적은 12,288차원의 임베딩 공간에서 수백만 개의 서로 다른 개념을 어떻게 수용하는지 탐구합니다. 실험과 존슨-린덴슈트라우스 보조정리 분석을 통해 저자는 고차원 기하학에서 "준직교" 벡터 관계의 중요성과 임베딩 공간에서 벡터 배열을 최적화하여 용량을 늘리는 방법을 밝힙니다. 연구 결과 완벽한 직교성에서의 편차를 고려하더라도 GPT-3의 임베딩 공간은 인간의 지식과 추론을 나타내기에 충분한 놀라운 용량을 가지고 있음을 보여줍니다.

더 보기