Word2Vec 성공의 비결: 전통적 방법과 신경망의 조화

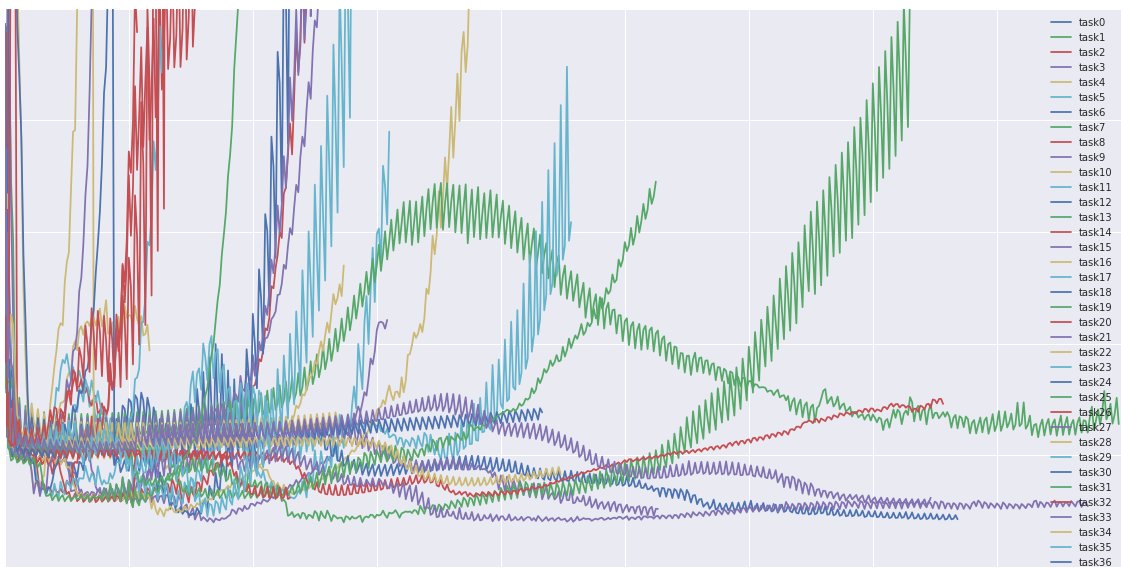

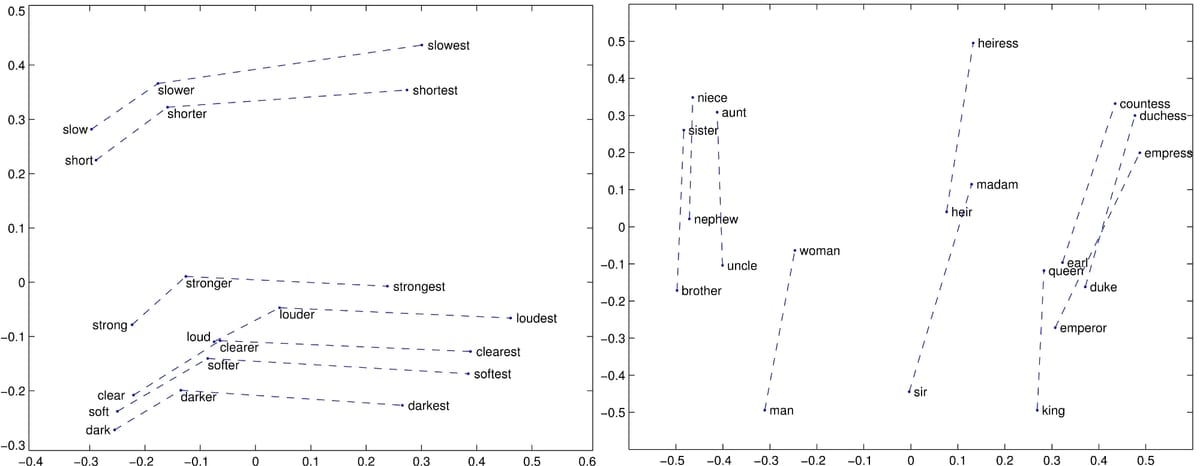

이 블로그 게시글에서는 Word2Vec의 성공에 기여하는 요인과 기존 단어 임베딩 모델과의 관계를 탐구합니다. GloVe, SVD, Skip-gram with Negative Sampling (SGNS), PPMI 등의 모델을 비교하여 하이퍼파라미터 조정이 알고리즘 선택보다 더 중요하다는 것을 보여줍니다. 연구 결과에 따르면 적절한 전처리 및 후처리를 통해 기존의 분포 의미론 모델(DSM)이 신경망 모델과 동등한 성능을 달성할 수 있음을 보여줍니다. 이 글에서는 전통적인 방법과 신경망 모델을 결합하는 이점을 강조하여 단어 임베딩 학습에 대한 새로운 관점을 제시합니다.

더 보기