محاذاة ميزات كثيرة الحدود مع توزيع البيانات: مشكلة الانتباه-المحاذاة في ML

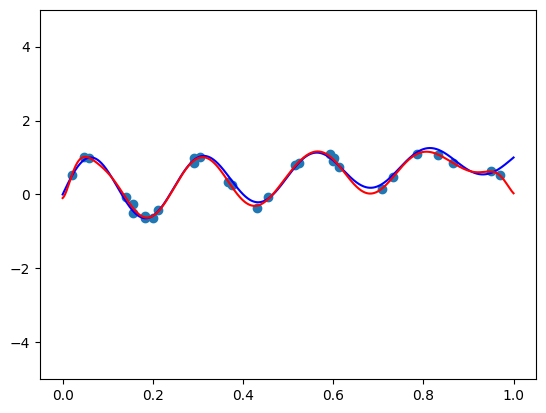

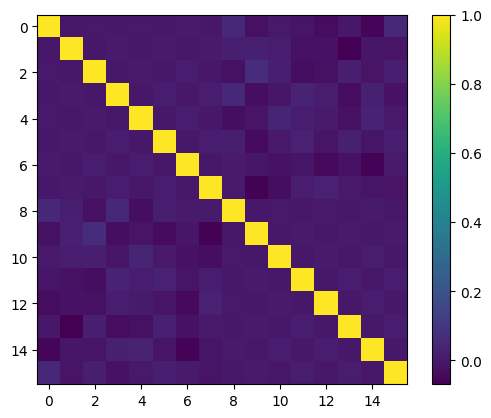

تتناول هذه التدوينة محاذاة ميزات كثيرة الحدود مع توزيع البيانات لتحسين أداء نموذج التعلم الآلي. تنتج القواعد المتعامدة ميزات إعلامية عندما تكون البيانات موزعة بشكلٍ منتظم، ولكن هذا ليس هو الحال مع البيانات الواقعية. يُعرض نهجان: خدعة رسم الخرائط، التي تُحوّل البيانات إلى توزيعٍ منتظم قبل تطبيق قاعدة متعامدة؛ والضرب في دالة مختارة بعناية لضبط دالة الوزن للقاعدة المتعامدة بحيث تتوافق مع توزيع البيانات. النهج الأول أكثر عملية، ويمكن تحقيقه باستخدام QuantileTransformer من مكتبة Scikit-Learn. أما الثاني فهو أكثر تعقيدًا، ويتطلب فهمًا رياضيًا أعمق وضبطًا دقيقًا. تُظهر التجارب على مجموعة بيانات الإسكان في كاليفورنيا أن الميزات شبه المتعامدة من النهج الأول تتفوق على القياس الأدنى-الأقصى التقليدي في الانحدار الخطي.

اقرأ المزيد