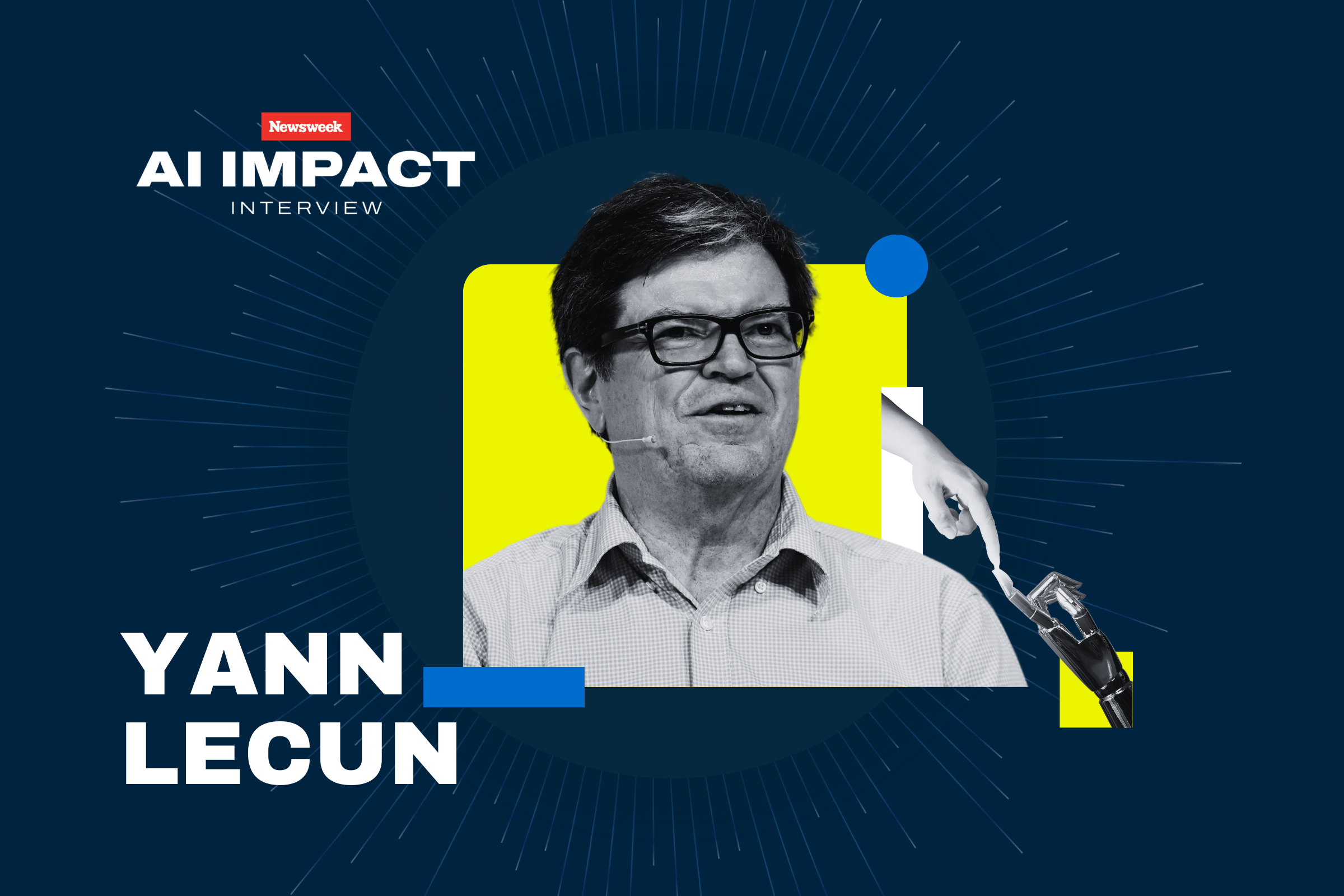

LeCun: Los modelos de lenguaje grandes estarán obsoletos en cinco años

Yann LeCun, científico jefe de IA de Meta, predice que los grandes modelos de lenguaje (LLM) estarán en gran medida obsoletos en cinco años. Argumenta que los LLM actuales carecen de comprensión del mundo físico, funcionando como herramientas especializadas en un espacio discreto y simple (el lenguaje). LeCun y su equipo están desarrollando un enfoque alternativo llamado JEPA, que busca crear representaciones del mundo físico a partir de la entrada visual, permitiendo verdaderas capacidades de razonamiento y planificación que superan a los LLM. Prevé que la IA transformará la sociedad al aumentar la inteligencia humana, no al reemplazarla, y refuta las afirmaciones de que la IA representa un riesgo existencial.