¿Reemplazará la generación de código de IA a los ingenieros humanos?

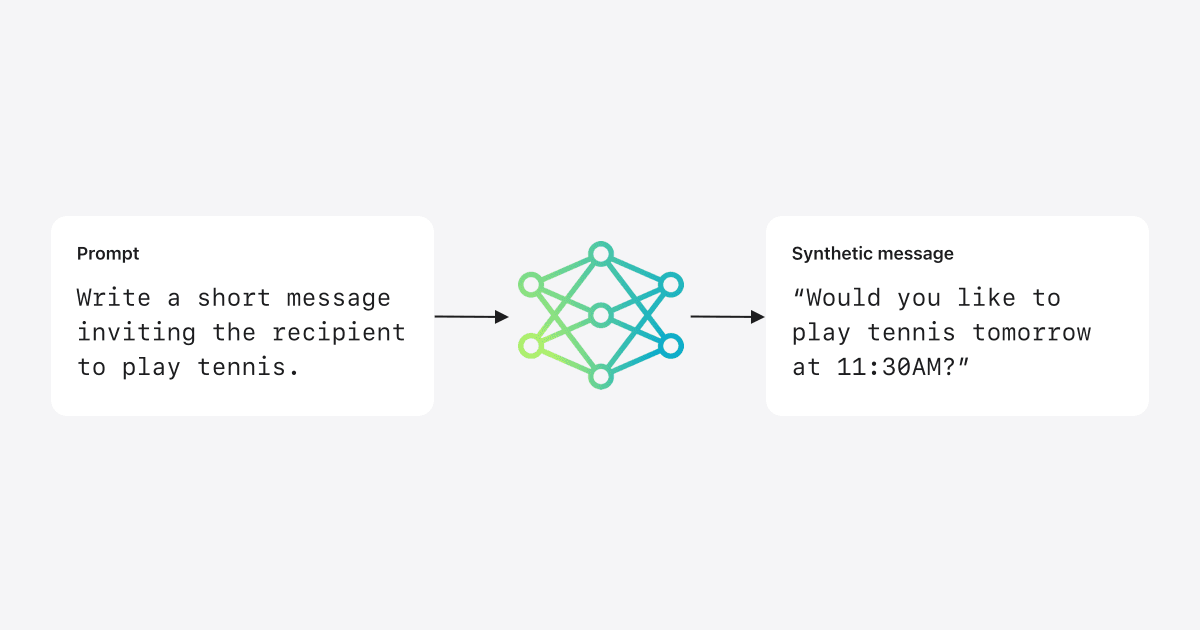

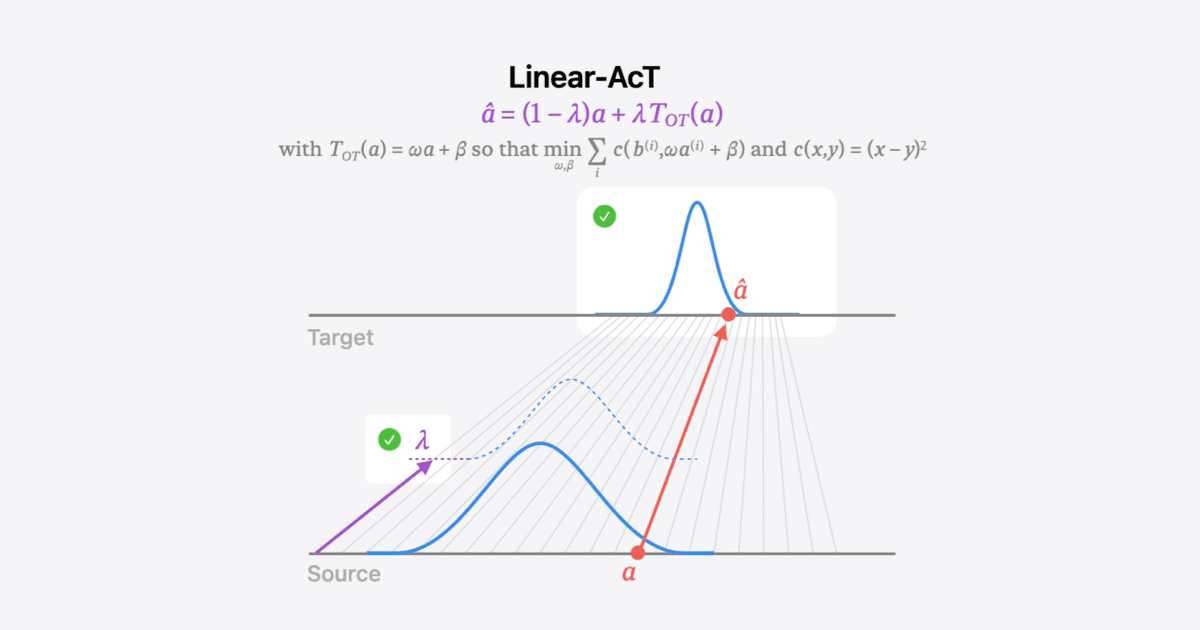

Este artículo explora la comparación de productividad entre los modelos de generación de código de IA (como Gemini) y los ingenieros humanos. Si bien actualmente un solo ingeniero puede ser más eficiente, los costos de los modelos de IA están disminuyendo y sus capacidades están mejorando. En el futuro, una gran cantidad de modelos de IA trabajando juntos, junto con bases de código y herramientas de desarrollo optimizadas para IA, superarán con creces a los equipos humanos en eficiencia. El artículo predice que la industria de la ingeniería de software se moverá hacia la industrialización, y el papel de los ingenieros cambiará a gestionar y supervisar la IA como 'supervisores de fábrica'.