El dilema ético de los LLM: Por qué dejé de usarlos

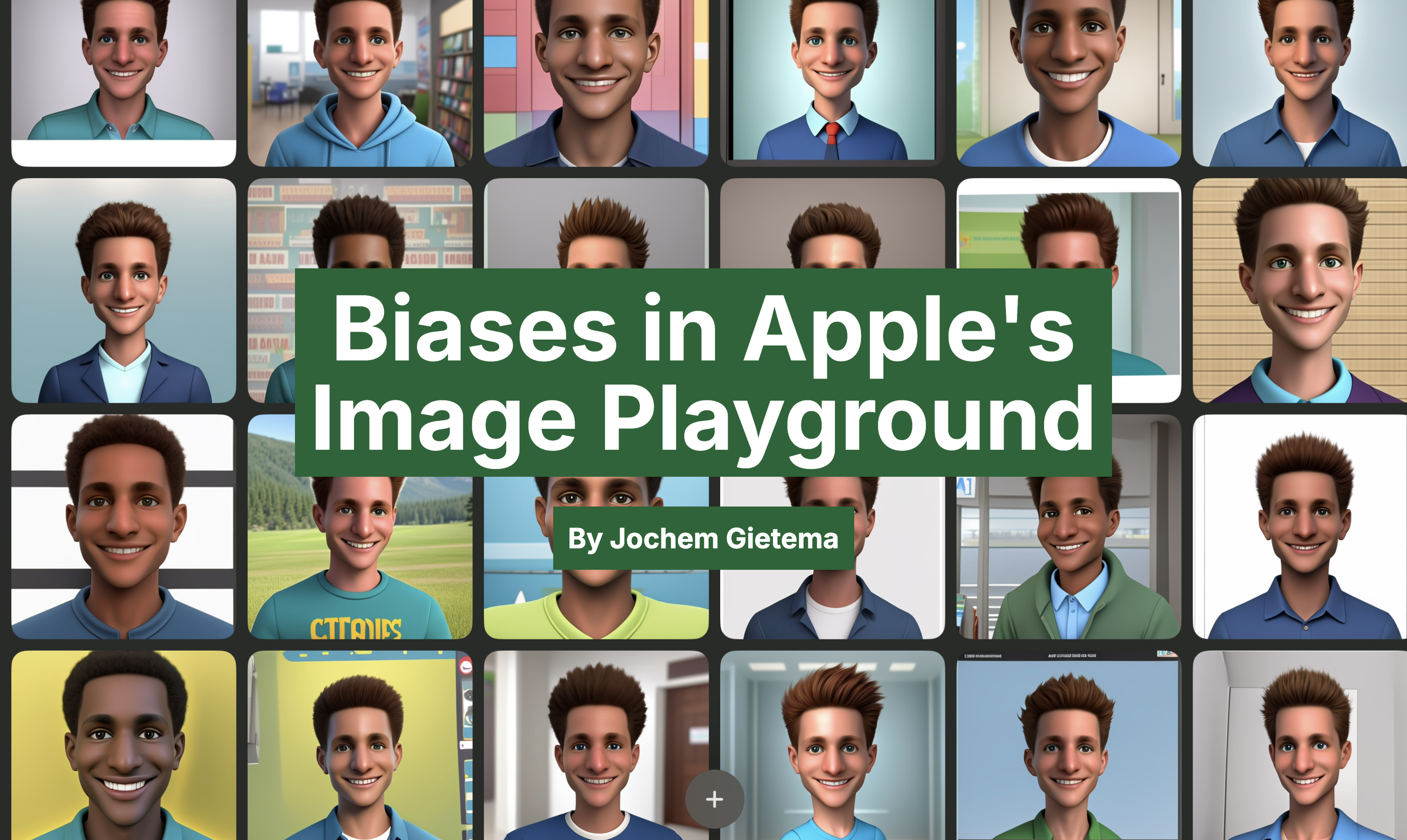

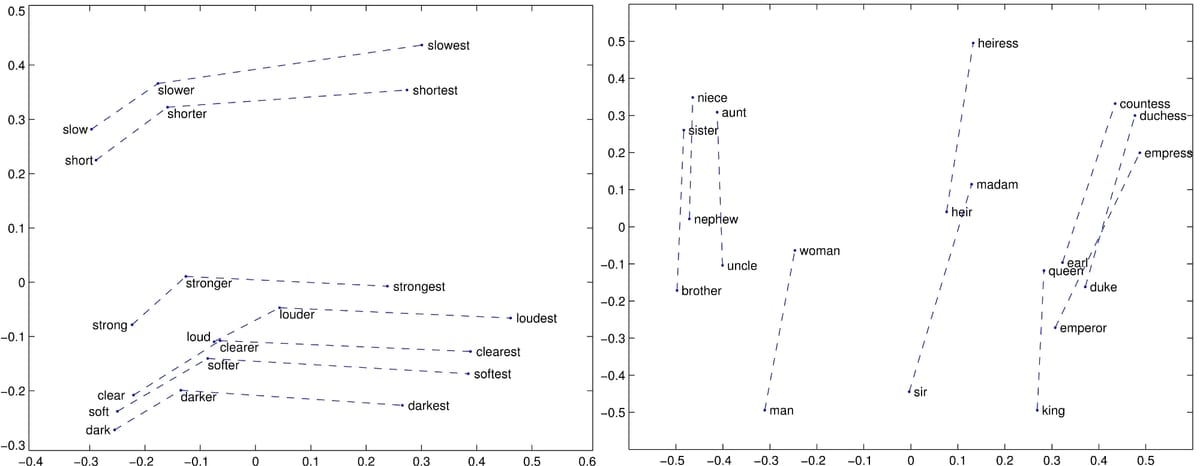

Esta publicación profundiza en las preocupaciones éticas en torno a los Modelos de Lenguaje Grandes (LLM) y explica la decisión del autor de dejar de usarlos. El autor explora cinco cuestiones principales: consumo de energía, origen de los datos de entrenamiento, desplazamiento laboral, información imprecisa y sesgos, y concentración de poder. El alto consumo de energía, las preocupaciones de privacidad relacionadas con los datos de entrenamiento, el potencial de desplazamiento laboral, el riesgo de desinformación debido a sesgos e imprecisiones, y la concentración de poder en manos de unas pocas grandes empresas tecnológicas se destacan como problemas éticos significativos. El autor argumenta que usar LLM sin abordar activamente estas preocupaciones éticas es antiético.