프롬프트 인젝션으로부터 LLM 에이전트를 보호하기 위한 6가지 디자인 패턴

2025-06-13

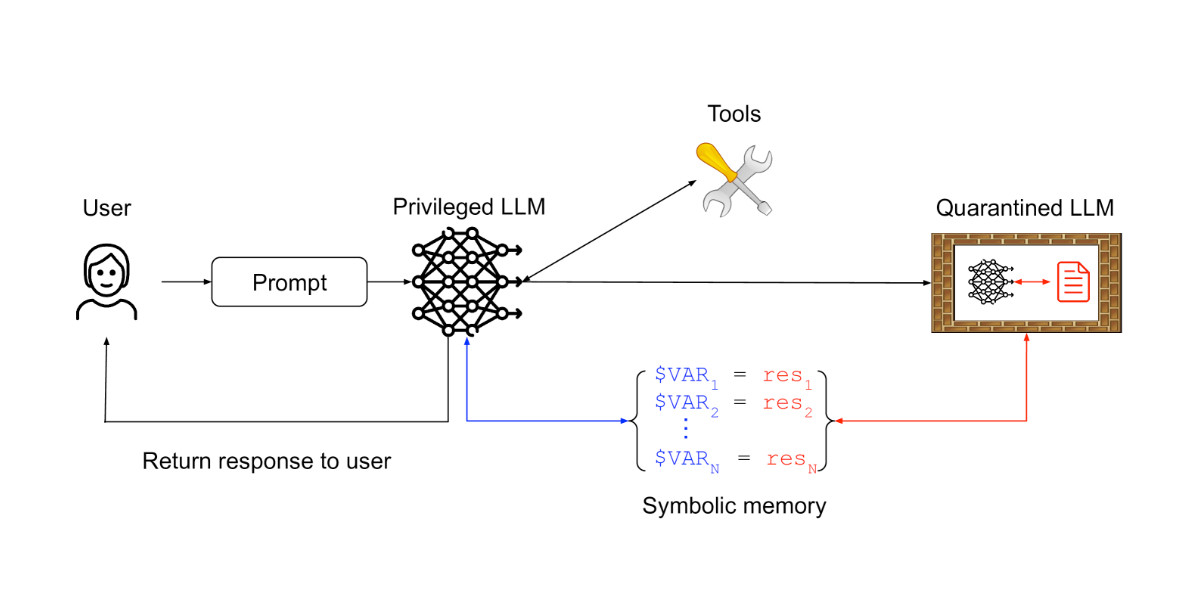

IBM, Invariant Labs 등 여러 기관의 연구원들이 발표한 새로운 논문에서는 대규모 언어 모델(LLM) 에이전트에 대한 프롬프트 인젝션 공격 위험을 완화하기 위한 6가지 디자인 패턴을 제시합니다. 이러한 패턴은 에이전트의 동작을 제한하여 임의의 작업 실행을 방지합니다. 예를 들어, 툴의 피드백이 에이전트에 영향을 미치는 것을 방지하는 액션 선택기 패턴, 툴 호출을 미리 계획하는 계획-실행 패턴, 신뢰할 수 없는 콘텐츠에 대한 노출을 피하기 위해 특권 LLM이 격리된 LLM을 조정하는 이중 LLM 패턴 등이 있습니다. 이 논문에서는 다양한 애플리케이션에 대한 10가지 사례 연구도 제시하여 안전하고 신뢰할 수 있는 LLM 에이전트를 구축하기 위한 실용적인 지침을 제공합니다.

AI