GPT-5: 가격, 모델 카드, 주요 기능 심층 분석

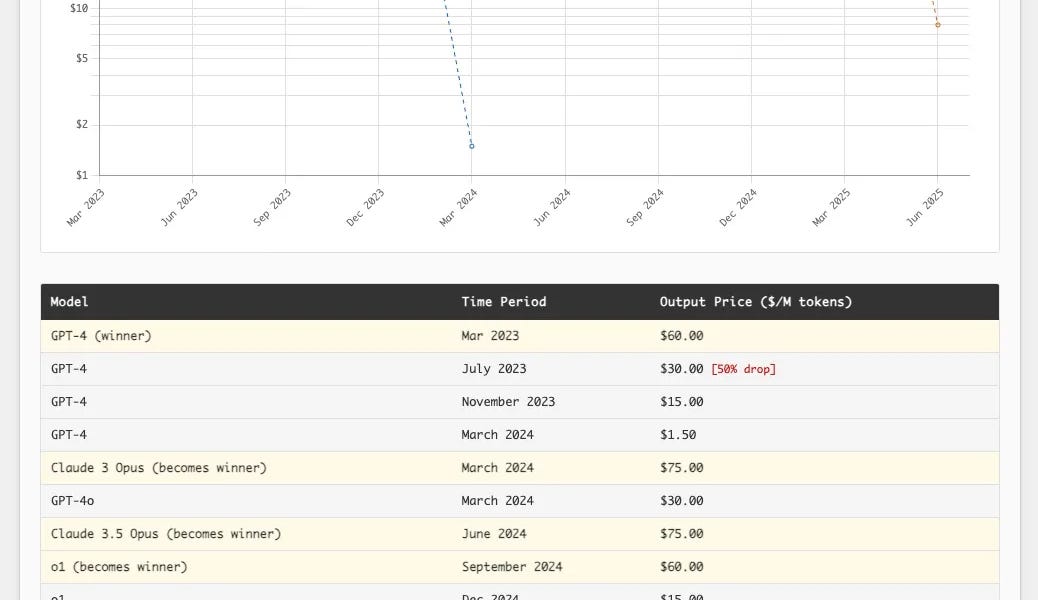

OpenAI의 GPT-5 패밀리가 출시되었습니다! 혁명적인 도약은 아니지만, 신뢰성과 사용 편의성 측면에서 이전 모델들을 크게 능가합니다. ChatGPT에서는 GPT-5가 문제의 난이도에 따라 모델을 지능적으로 전환하는 하이브리드 시스템입니다. API 버전에서는 표준, 미니, 나노 세 가지 모델이 제공되며, 네 가지 추론 수준을 지원합니다. 입력 토큰 수는 272,000개, 출력 토큰 수는 128,000개이며, 텍스트와 이미지 입력이 가능하지만 출력은 텍스트만 가능합니다. 가격 경쟁력이 매우 높아 경쟁사들을 크게 압도합니다. 또한 GPT-5는 환각 감소, 지시 사항 준수 개선, 아첨 최소화 측면에서 눈에 띄는 발전을 보였으며, 새로운 안전 교육 방식을 채택했습니다. 글쓰기, 코딩, 의료 분야에서 뛰어난 성능을 발휘합니다. 하지만 프롬프트 인젝션은 여전히 해결되지 않은 과제입니다.

![오픈소스 이미지 모델 FLUX.1-Krea [dev]: 'AI스러운' 외형 극복](https://www.krea.ai//_app/77be82153701096c/immutable/assets/thumbnail.DSqx6EeB.webp)