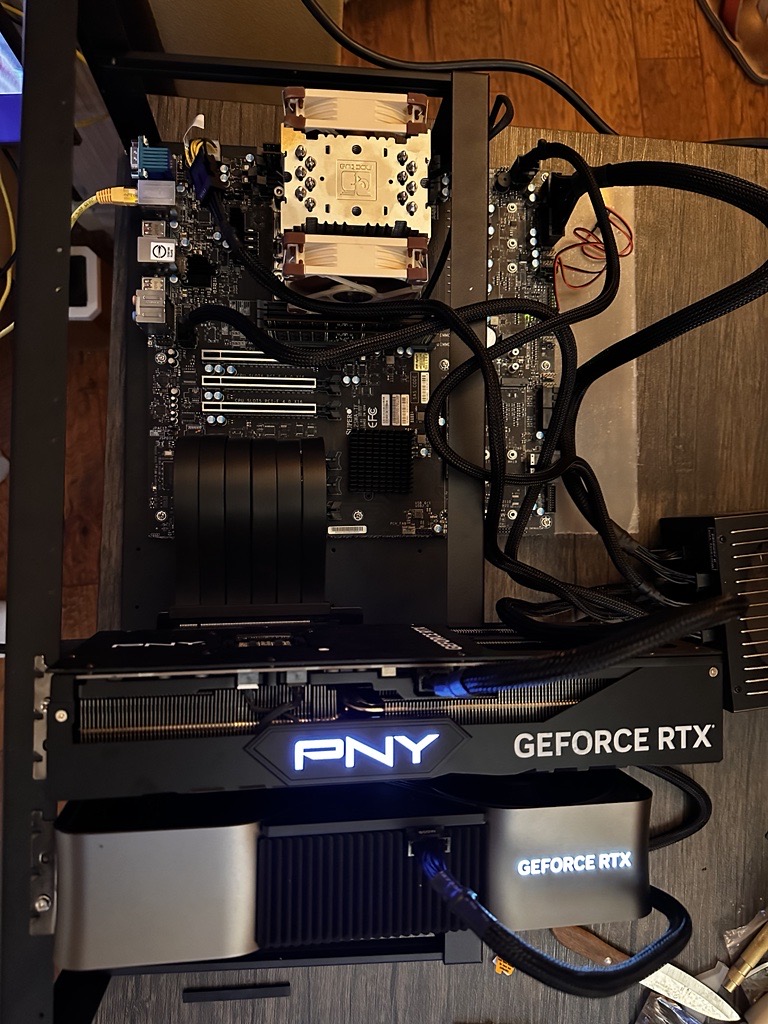

4 GPU 4090 : Entraînement local de vos propres LLMs

Un passionné d'IA a construit une configuration locale pour entraîner des grands modèles de langage (LLMs) à l'aide de quatre GPU NVIDIA 4090, pour un coût d'environ 12 000 $. Cette configuration peut entraîner des modèles jusqu'à 1 milliard de paramètres, bien qu'elle soit optimale avec environ 500 millions. L'article détaille le choix du matériel (carte mère, CPU, RAM, GPU, stockage, alimentation, boîtier, refroidissement), le processus d'assemblage, la configuration du logiciel (système d'exploitation, pilotes, frameworks, noyau personnalisé), l'entraînement du modèle, l'optimisation et la maintenance. Des conseils incluent l'utilisation du patch de noyau de George Hotz pour la communication P2P sur les GPU 4xxx. Tout en soulignant les avantages de l'entraînement local, l'auteur reconnaît le rapport coût-efficacité des solutions cloud pour certaines tâches.