Información obsoleta en LLMs: cómo las probabilidades de tokens crean inconsistencias lógicas

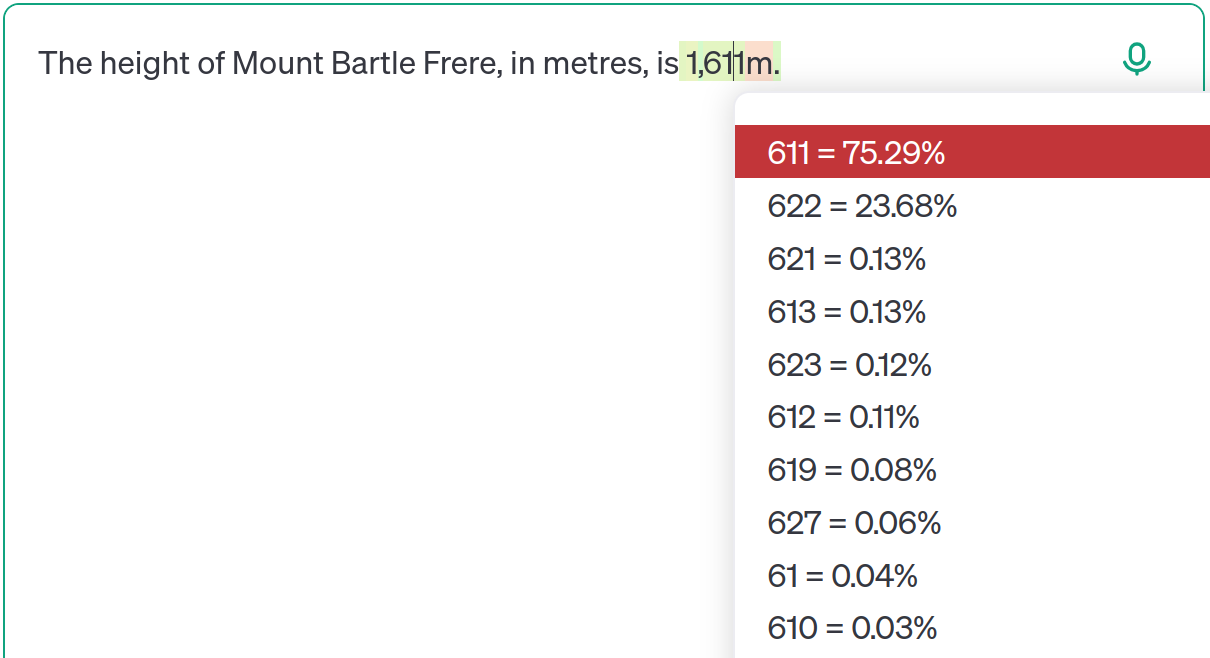

Los modelos de lenguaje grandes (LLMs) como ChatGPT, entrenados con conjuntos de datos masivos de internet, a menudo se enfrentan a información contradictoria u obsoleta. Este artículo utiliza la altura del Monte Bartle Frere como un caso de estudio, mostrando cómo los LLMs no siempre priorizan la información más reciente. En cambio, realizan predicciones basadas en distribuciones de probabilidad aprendidas de sus datos de entrenamiento. Incluso modelos avanzados como GPT-4o pueden producir información obsoleta dependiendo de variaciones sutiles en el prompt. Esto no es una simple 'alucinación', sino una consecuencia de que el modelo aprenda múltiples posibilidades y ajuste las probabilidades según el contexto. El autor destaca la importancia de comprender las limitaciones de los LLMs, evitando la dependencia excesiva y enfatizando la transparencia.