Veraltete Informationen verstecken sich in LLMs: Wie Token-Wahrscheinlichkeiten logische Inkonsistenzen erzeugen

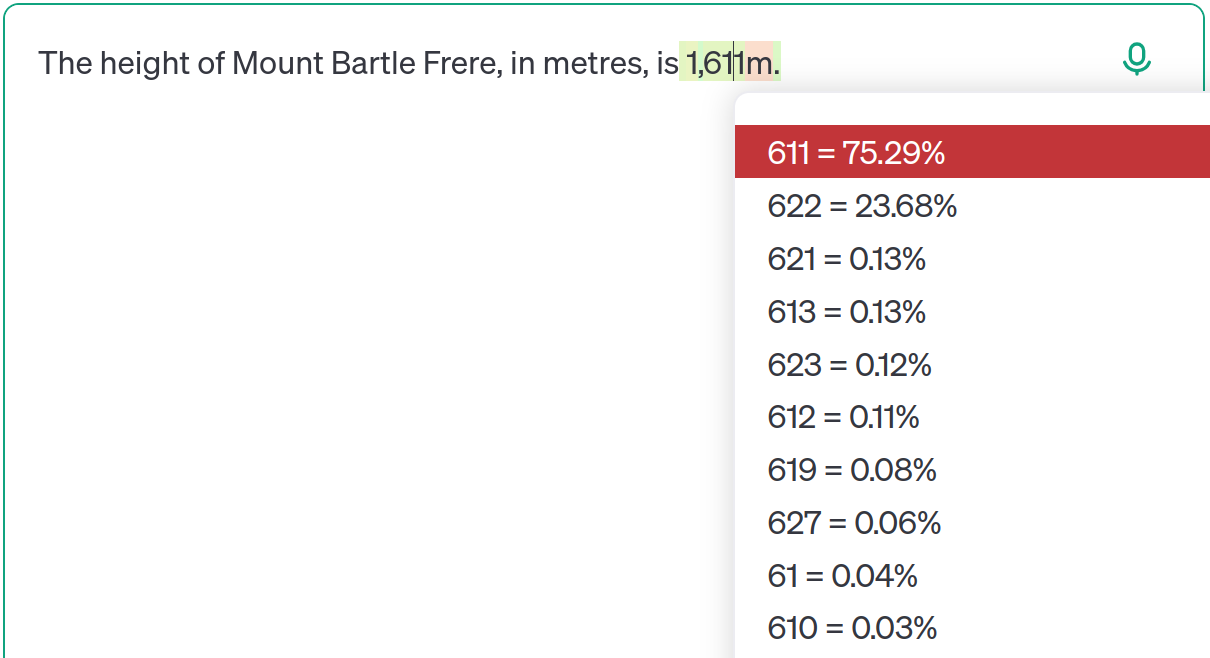

Große Sprachmodelle (LLMs) wie ChatGPT, die mit massiven Internet-Datensätzen trainiert wurden, haben oft mit widersprüchlichen oder veralteten Informationen zu kämpfen. Dieser Artikel verwendet die Höhe des Mount Bartle Frere als Fallstudie und zeigt, wie LLMs nicht immer die neuesten Informationen priorisieren. Stattdessen treffen sie Vorhersagen basierend auf Wahrscheinlichkeitsverteilungen, die aus ihren Trainingsdaten gelernt wurden. Selbst fortschrittliche Modelle wie GPT-4o können veraltete Informationen ausgeben, abhängig von subtilen Änderungen der Eingabeaufforderung. Dies ist keine einfache „Halluzination“, sondern eine Folge davon, dass das Modell mehrere Möglichkeiten lernt und die Wahrscheinlichkeiten je nach Kontext anpasst. Der Autor betont die Wichtigkeit, die Grenzen von LLMs zu verstehen, übermäßige Abhängigkeit zu vermeiden und Transparenz zu betonen.