DeepSeek:绕过CUDA的AI突破

2025-01-29

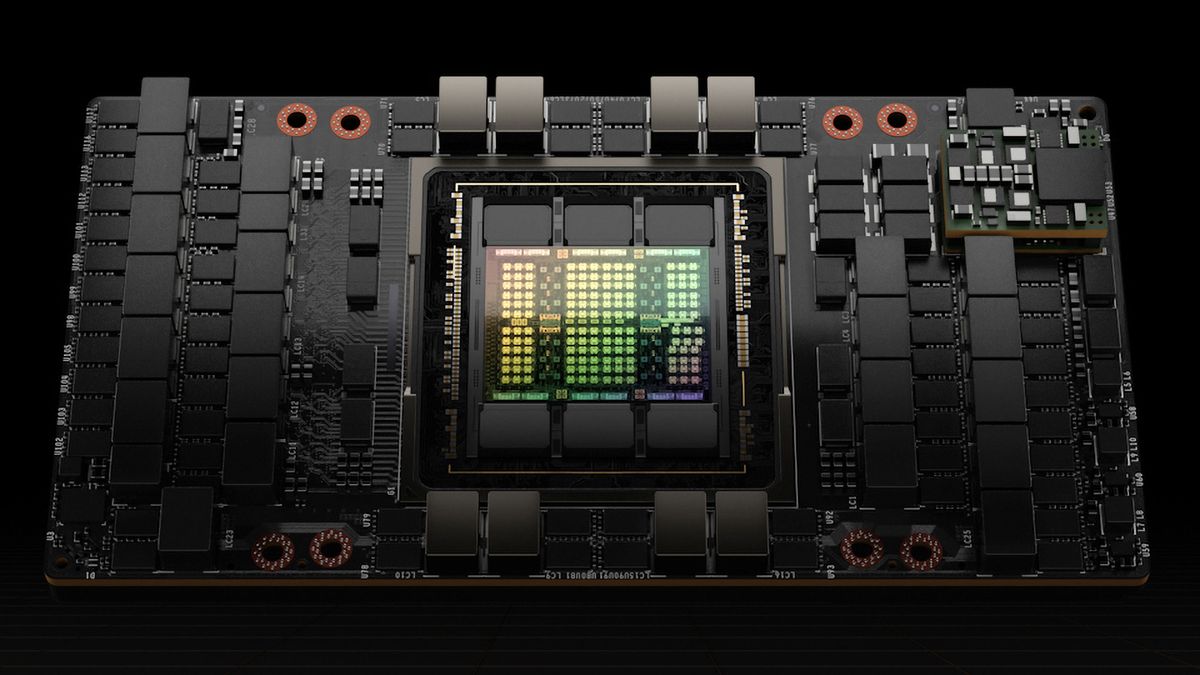

DeepSeek公司通过使用Nvidia的PTX编程语言而非行业标准CUDA,在AI模型训练效率上实现了10倍的提升。他们利用2048个Nvidia H800 GPU,在两个月内训练了一个拥有6710亿参数的MoE语言模型。这一突破源于对Nvidia PTX的精细化优化,包括重新配置GPU资源和实现高级流水线算法。虽然这种方法维护成本高,但显著降低了AI模型训练的成本,引发了市场震动,甚至导致Nvidia市值大幅缩水。

AI

PTX