DeepSeek의 AI 돌파구: CUDA 우회를 통한 10배 효율 향상

2025-01-29

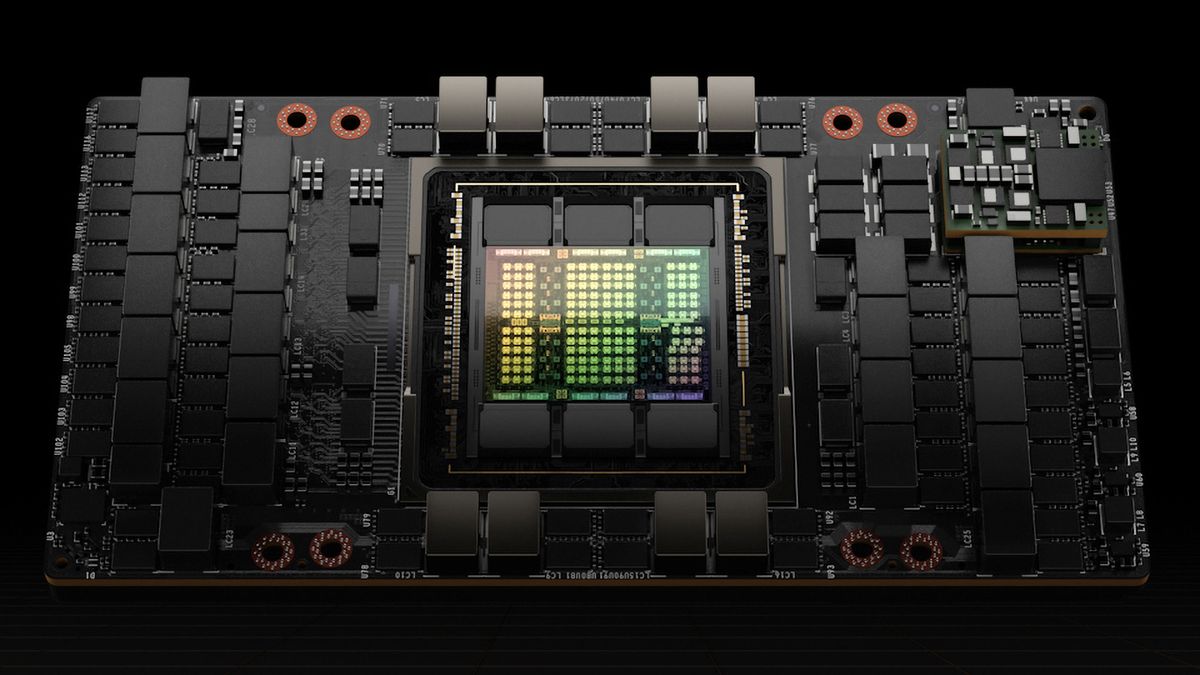

DeepSeek은 업계 표준인 CUDA를 우회하고 Nvidia의 PTX 프로그래밍 언어를 사용하여 AI 모델 학습 효율을 10배 향상시켰습니다. 2048개의 Nvidia H800 GPU를 사용하여 불과 2개월 만에 6,710억 매개변수의 MoE 언어 모델을 학습했습니다. 이 돌파구는 Nvidia PTX에 대한 세심한 최적화, GPU 리소스 재구성, 고급 파이프라인 알고리즘 구현을 통해 이루어졌습니다. 이러한 접근 방식은 유지 보수 비용이 높지만, 학습 비용의 획기적인 절감은 시장에 충격을 주었고, 심지어 Nvidia의 시가 총액의 큰 감소까지 초래했습니다.

AI

AI 모델 학습