Verbesserter Crosscoder enthüllt Geheimnisse des Feintunings von LLMs

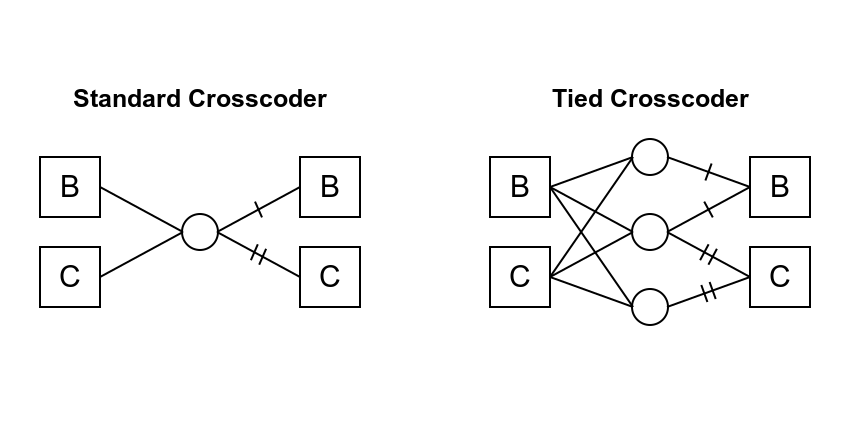

Forscher stellen eine neue Methode vor, den „gebundenen Crosscoder“, um die Basis- und die feinabgestimmten Chat-Modelle großer Sprachmodelle (LLMs) zu vergleichen. Im Gegensatz zu herkömmlichen Crosscodern ermöglicht der gebundene Crosscoder es denselben latenten Faktoren, zu unterschiedlichen Zeiten für das Basis- und das Chat-Modell zu feuern, was zu einer effizienteren Identifizierung neuer Merkmale im Chat-Modell führt. Experimente zeigen, dass dieser Ansatz klarere Erklärungen dafür liefert, wie sich das Chat-Verhalten aus den Fähigkeiten des Basismodells ergibt, und monosämantischere latente Faktoren erzeugt. Diese Forschung bietet neue Einblicke in den Feintuning-Prozess von LLMs und leitet zukünftige Modellverbesserungen.