Veo Generación 3: Generalización de la Generación de Vídeo

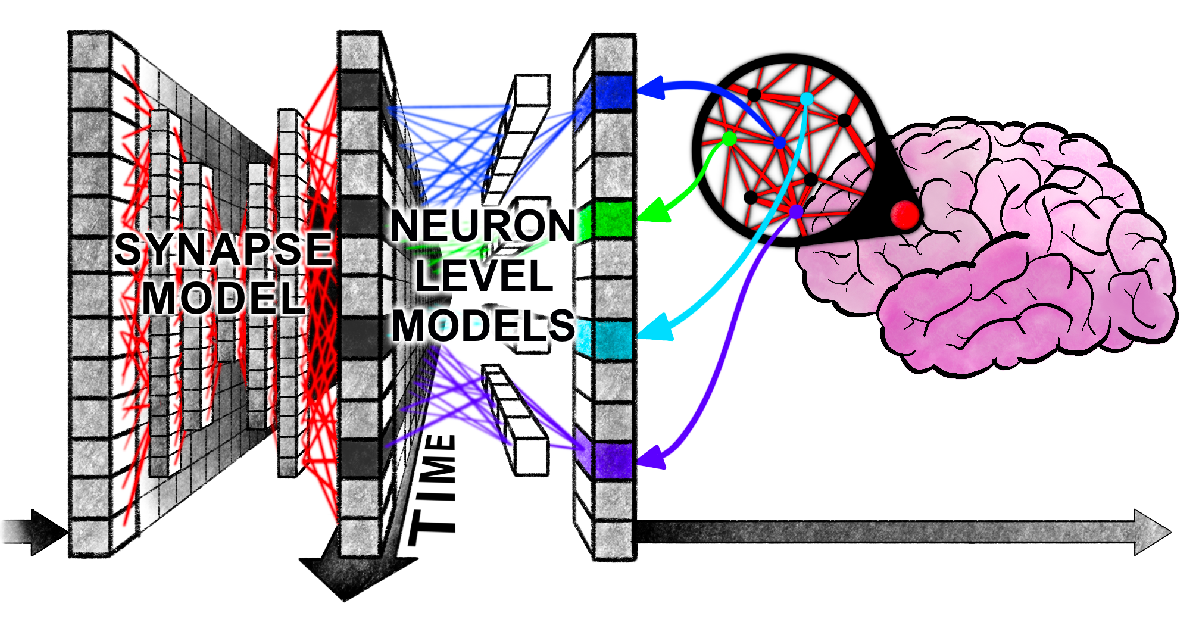

El último avance de Google en generación de vídeo, Veo, ahora cuenta con una tercera generación capaz de generalizar en diversas tareas. Entrenado con millones de activos sintéticos 3D de alta calidad, Veo sobresale en la síntesis de nuevas vistas, transformando imágenes de productos en vídeos 360° consistentes. Es importante destacar que este enfoque se generaliza eficazmente en muebles, ropa, electrónica y más, capturando con precisión las complejas interacciones de iluminación y materiales — una mejora significativa con respecto a las generaciones anteriores.