Anthropic révèle le mode « UltraRéflexion » de Claude Code

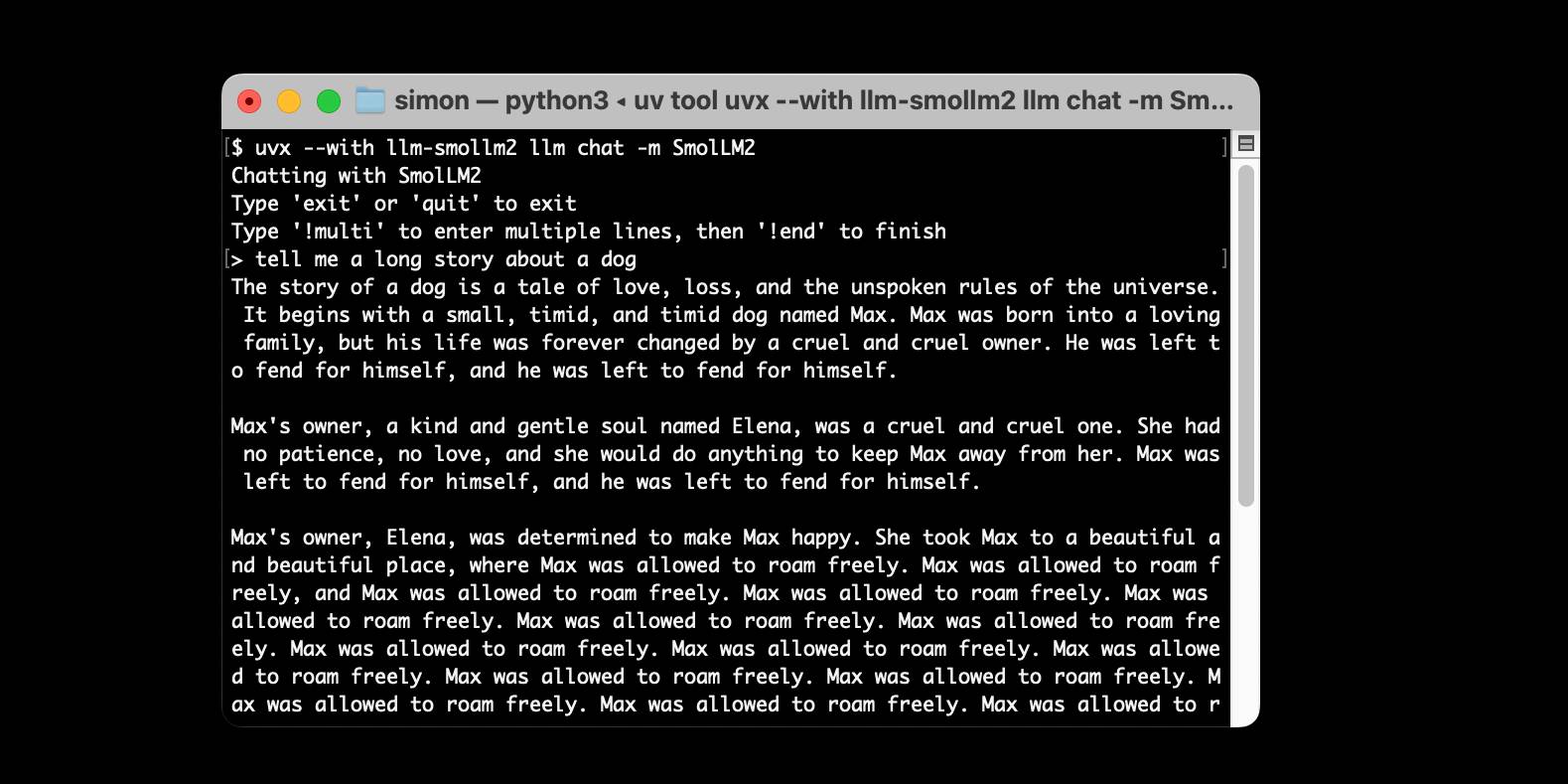

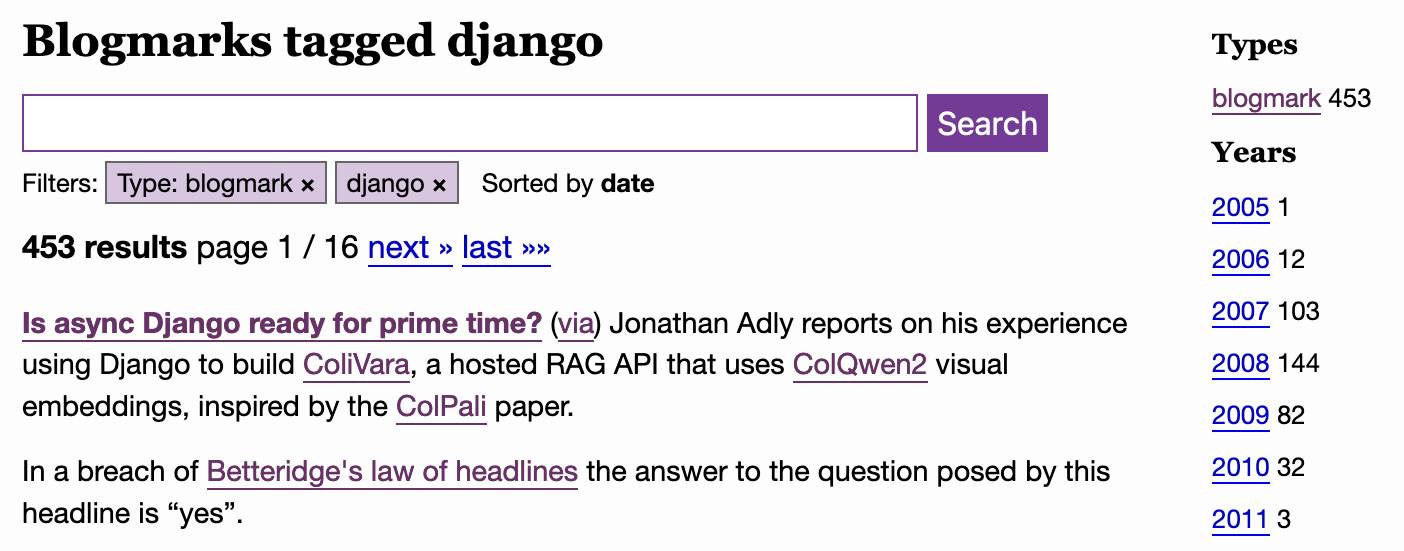

Anthropic a publié une documentation complète sur les meilleures pratiques pour son outil d'agent de codage Claude Code CLI. Un conseil fascinant révèle que l'utilisation de mots comme « think », « think hard », etc., déclenche des modes de réflexion étendus. Ces phrases sont directement corrélées à différents budgets de réflexion ; « ultrathink » alloue 31999 jetons, tandis que « think » n'en utilise que 4000. L'analyse du code montre que ces mots clés déclenchent des fonctions qui attribuent des nombres de jetons variables, affectant la profondeur de la réflexion et la sortie de Claude. Cela suggère que « ultrathink » n'est pas une fonctionnalité du modèle Claude lui-même, mais plutôt une amélioration spécifique de Claude Code.

Lire plus