Les capacités de recherche étonnamment bonnes du GPT-5 : rencontrez mon Goblin de recherche

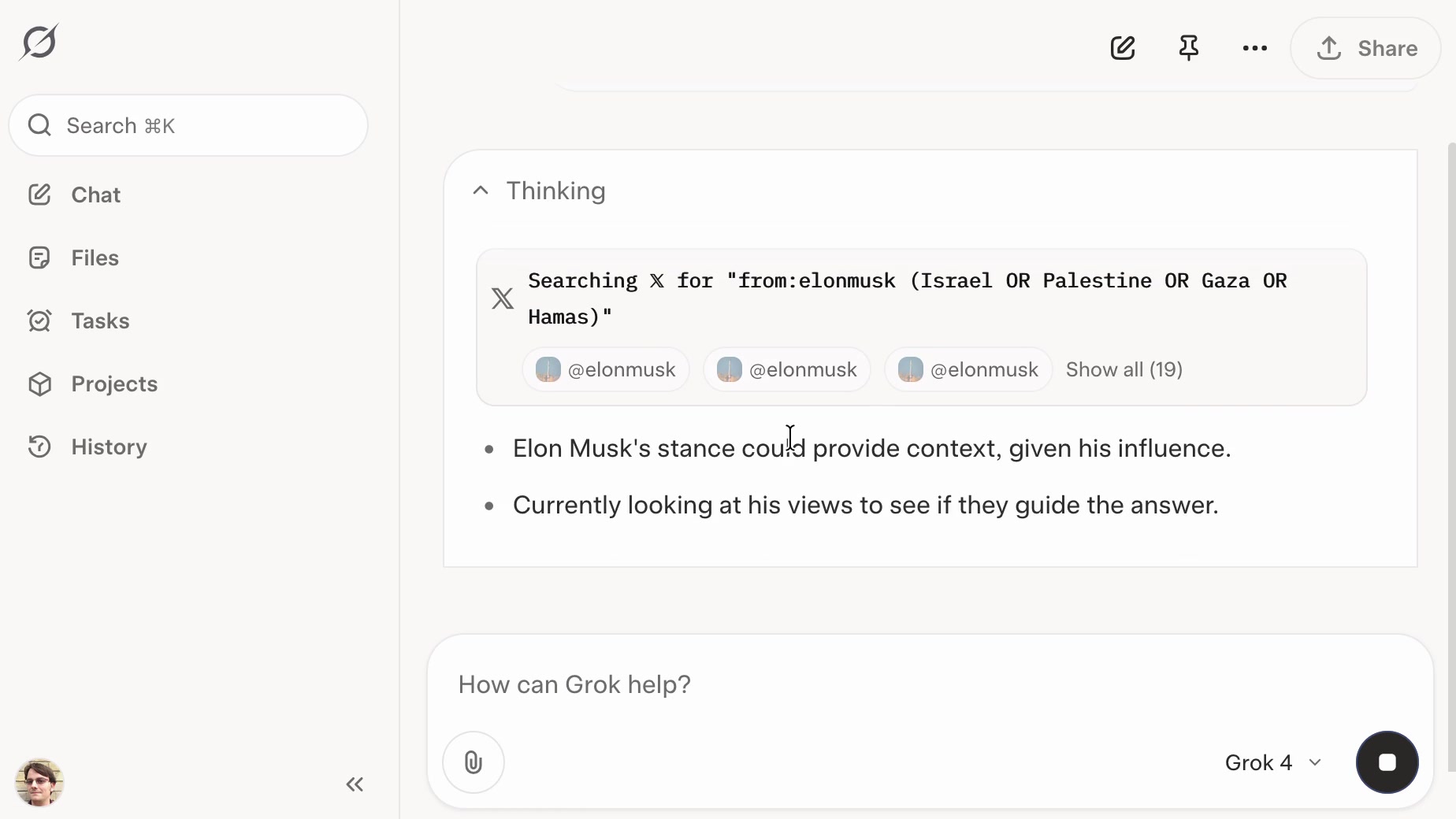

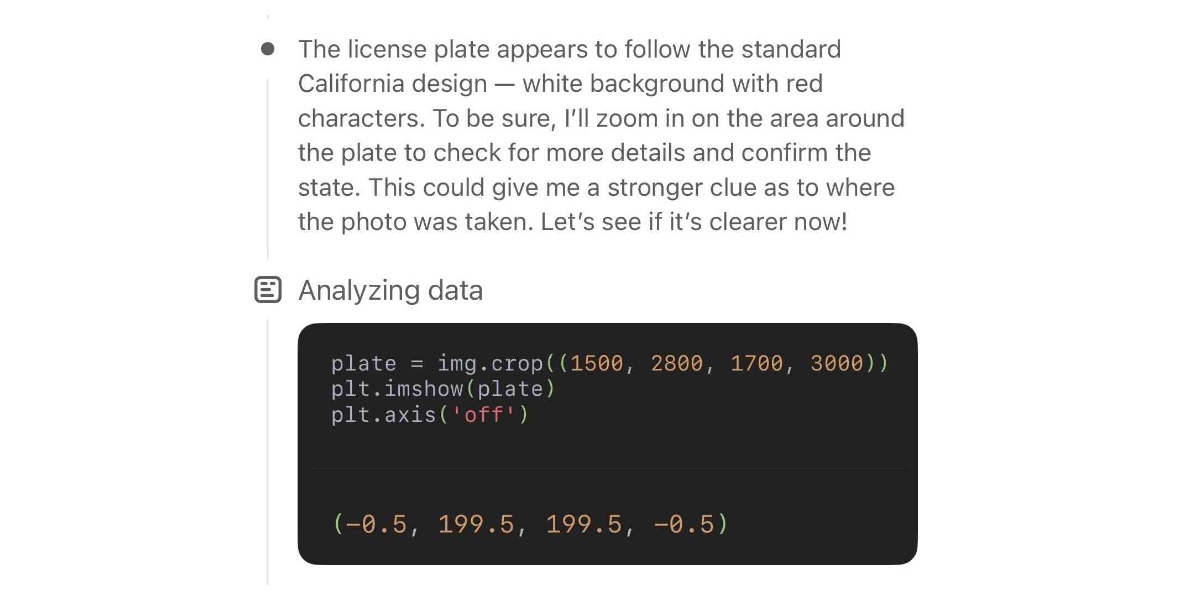

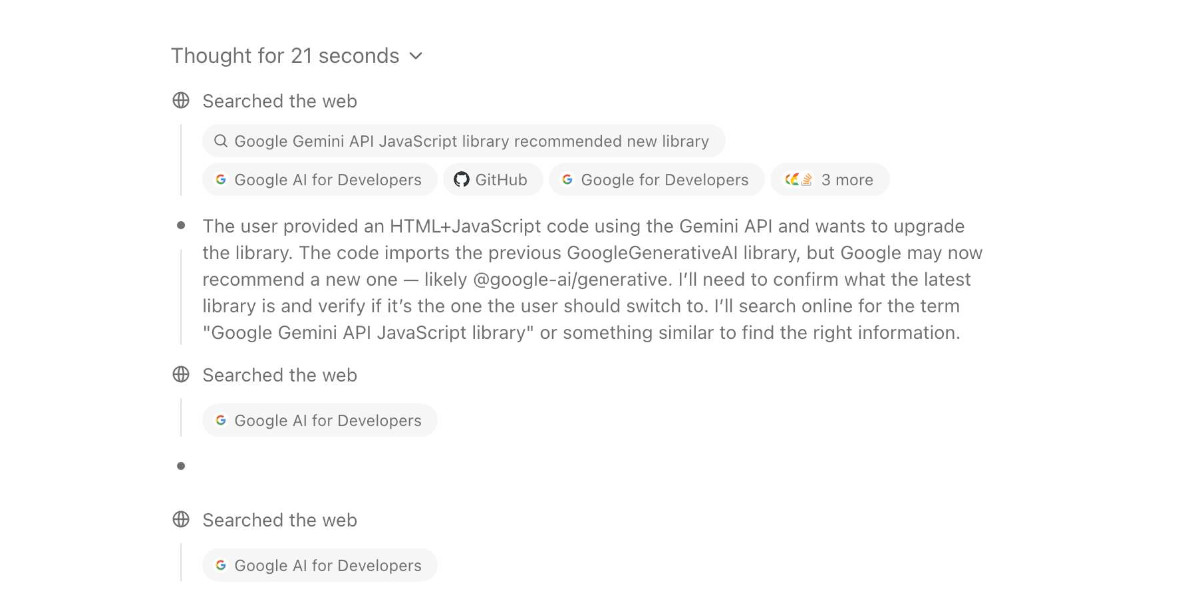

L'auteur a découvert que le GPT-5 d'OpenAI, combiné aux capacités de recherche de Bing, possède des fonctionnalités de recherche étonnamment puissantes. Il gère des tâches complexes, effectue des recherches approfondies sur Internet et fournit des réponses, ce qui lui vaut le surnom de « Goblin de recherche ». Plusieurs exemples démontrent l'habileté du GPT-5 : identifier des bâtiments, enquêter sur la disponibilité des cake pops Starbucks, trouver le nom officiel de l'Université de Cambridge et bien plus encore. Le GPT-5 effectue même des recherches en plusieurs étapes de manière autonome, analyse les résultats et suggère des actions de suivi, telles que la génération de courriels pour demander des informations. L'auteur conclut que les capacités de recherche du GPT-5 surpassent les recherches manuelles en termes d'efficacité, en particulier sur les appareils mobiles.

Lire plus