プロンプトインジェクションに対するLLMエージェントのセキュリティを確保するための6つのデザインパターン

2025-06-13

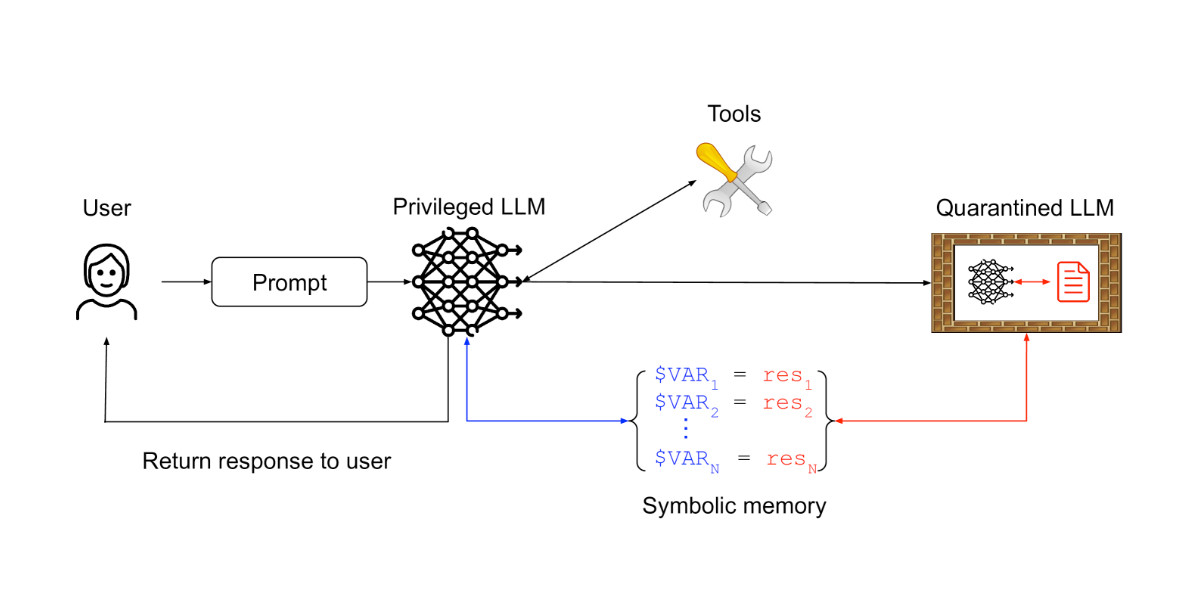

IBM、Invariant Labsなどの機関の研究者による新しい論文では、大規模言語モデル(LLM)エージェントに対するプロンプトインジェクション攻撃のリスクを軽減するための6つのデザインパターンが紹介されています。これらのパターンはエージェントのアクションを制約し、任意のタスクの実行を防ぎます。例としては、ツールのフィードバックがエージェントに影響を与えるのを防ぐアクションセレクターパターン、ツールの呼び出しを事前に計画するプラン・ゼン・エグゼクートパターン、信頼できないコンテンツへの露出を回避するために特権LLMが分離されたLLMを調整するデュアルLLMパターンなどがあります。この論文では、さまざまなアプリケーションにおける10のケーススタディも紹介されており、安全で信頼性の高いLLMエージェントの構築に関する実践的なガイダンスを提供しています。

AI