GPT-3の驚くべき埋め込み容量:高次元幾何学とジョンソン・リンデンシュトラウス補題

2025-09-15

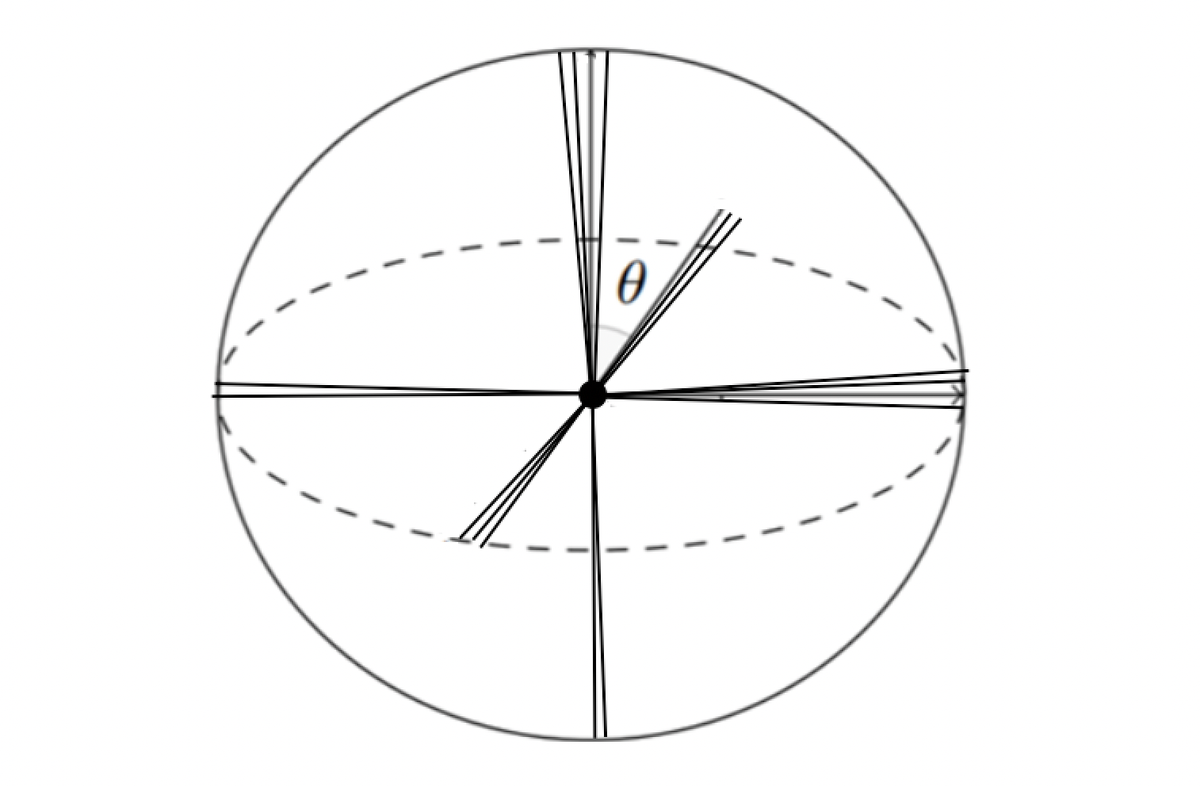

この記事では、GPT-3などの大規模言語モデルが、比較的控えめな12,288次元の埋め込み空間で、どのように何百万もの異なる概念を収容できるのかを探っています。実験とジョンソン・リンデンシュトラウス補題の分析を通じて、著者は高次元幾何学における「準直交」ベクトル関係の重要性、および埋め込み空間におけるベクトルの配置を最適化して容量を増やす方法を明らかにしています。研究の結果、完全な直交性からのずれを考慮しても、GPT-3の埋め込み空間は、人間の知識と推論を表すのに十分な驚くべき容量を持っていることがわかりました。

続きを読む