Anthropic의 Claude AI: 멀티 에이전트 시스템 기반 웹 검색

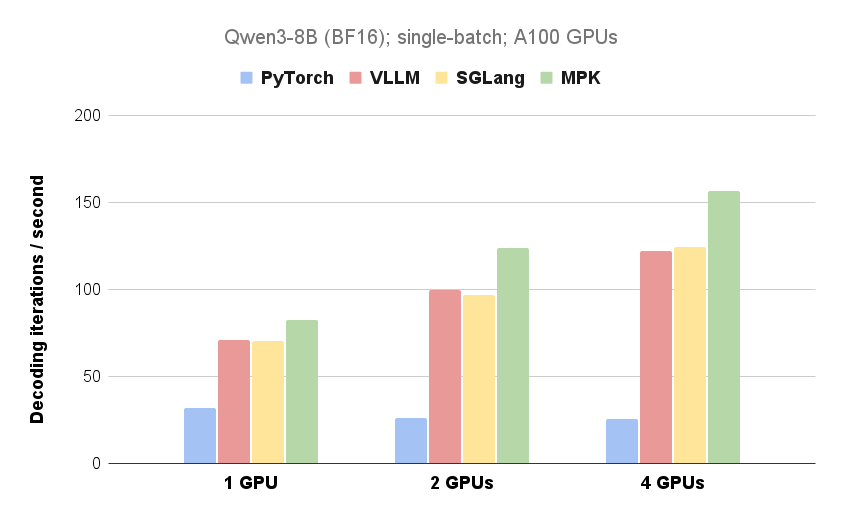

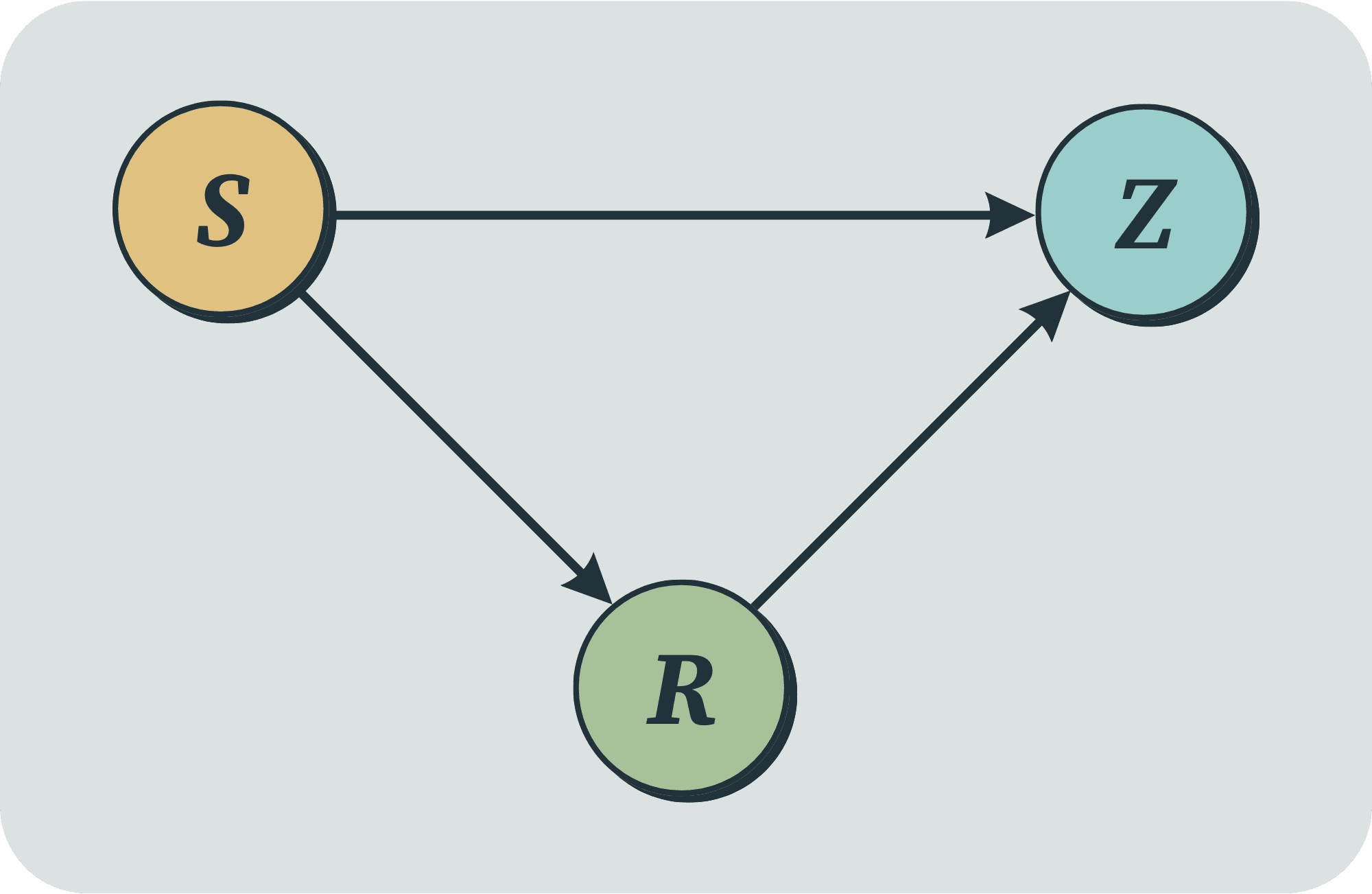

Anthropic은 자사의 대규모 언어 모델 Claude에 새로운 연구 기능을 도입했습니다. 이 기능은 멀티 에이전트 시스템을 활용하여 웹, Google Workspace 및 모든 통합 도구를 검색하고 복잡한 작업을 수행합니다. 본 게시글에서는 시스템 아키텍처, 도구 설계 및 프롬프트 엔지니어링에 대한 세부 정보를 설명하고 멀티 에이전트 협업, 병렬 검색 및 동적 정보 검색을 통해 검색 효율성이 어떻게 향상되는지 강조합니다. 멀티 에이전트 시스템은 더 많은 토큰을 소모하지만, 광범위한 검색과 병렬 처리가 필요한 작업에서는 단일 에이전트 시스템을 크게 능가합니다. 이 시스템은 내부 평가에서 뛰어난 성과를 거두었으며, 특히 여러 방향을 동시에 탐색하는 너비 우선 쿼리에서 두드러집니다.